4 Er de juridiske rammebetingelsene avklart?

4.1 Innledning

Virksomheter som ønsker å ta i bruk KI-assistenter og/eller språkmodeller, må sikre at bruken skjer i samsvar med gjeldende regelverk, særlig den kommende KI-forordningen ( EU Artificial Intelligence ACT – AI ACT ) og den gjeldende personvernforordningen ( EU General Data Protection Regulation – GDPR ). Andre regelverk kan også gjelde, avhengig av bruken og sektoren. I tillegg må kritikaliteten til data som inngår enten til trening, finjustering, utvikling eller bruk av modellene vurderes.

Under redegjøres det for sentrale forhold virksomheten bør vurdere dersom anvendelsen omfattes av kravene i KI-forordningen og/eller personvernforordningen.

4.2 KI-forordningen (EU AI ACT)

4.2.1 Generelt om KI-forordningen

KI-forordningen er EUs nye, risikobaserte regelverk for kunstig intelligens. Formålet er å sikre at bruken av KI er trygg, ansvarlig og i tråd med europeiske verdier og rettigheter. Forordningen trådte formelt i kraft i EU 1. august 2024. Reglene vil gjelde for norske virksomheter gjennom EØS-avtalen. Regjeringen har varslet en egen gjennomføringslov som etter planen skal tre i kraft i løpet av sensommeren 2026.

Virksomheter kan omfattes av regelverket enten fordi de utvikler, innlemmer, videreselger eller bruker KI-systemer.

Etter KI-forordningen er det den tiltenkte bruken av KI-systemet som bestemmer risikoklassen, ikke bare KI-systemet i seg selv. Det samme KI-systemet kan derfor ha lav risiko i én brukssituasjon, men høy risiko i en annen. KI-modeller til generelle formål (General-Purpose AI models - GPAI- models ) har ikke ett bestemt, tiltenkt formål, og faller inn under spesifikke reguleringer i KI-forordningen.

KI-forordningen består av flere kapitler som regulerer ulike aspekter ved bruk og utvikling av kunstig intelligens.

Kravene til utvikling og bruk etter reguleringen er lagt opp som en pyramide: Først er det angitt visse typer KI-systemer som er forbudte. Videre knytter de strengeste kravene seg til høyrisiko KI-systemer , og generelle KI-modeller med systemisk risiko . Deretter følger noe lempeligere krav til KI-systemer med begrenset risiko (transparensforpliktelser).

For KI-systemer med minimal risiko er det ikke angitt særskilte krav. Forordningen innfører slikt sett en helhetlig tilnærming til risikohåndtering av KI-systemer, med fokus på sikkerhet, transparens og grunnleggende menneskerettigheter. 4

KI-modeller til generelle formål, er spesielt regulert i KI-forordningen på grunn av deres generelle anvendbarhet og evne til å bli tilpasset ulike formål, hvilket skaper utfordringer knyttet til risikovurdering og ansvarsfordeling mellom utviklere og brukere av modellene. Forordningen stiller derfor strenge krav til dokumentasjon, åpenhet om treningsdata, etterlevelse av opphavsrett og risikohåndtering for å sikre ansvarlig utvikling og implementering. Bruk av generelle KI-modeller, som for eksempel ulike versjoner av ChatGPT, Claude eller Gemini, må derfor vurderes konkret. Virksomheter som tar i bruk slike generelle løsninger uten å videreutvikle eller tilby dem videre omfattes ikke av de samme pliktene som leverandørene, men har et selvstendig ansvar for korrekt og lovlig bruk. Se vedlegg 11.4 for sjekkliste og råd ved bruk av KI-assistenter som bruker generelle KI-modeller.

Det er lagt opp til en rekke krav til gjennomsiktighet (transparensforpliktelser) i KI-forordningen. De som bruker et KI-system skal gjøres kjent med at de samhandler med et KI-system, med mindre dette er åpenbart eller systemet brukes til kriminalitetsbekjempende formål. Innhold generert av et KI-system skal merkes i et maskinlesbart format. De som blir utsatt for et KI-system som bruker biometrisk kategorisering eller følelsesgjenkjenning, skal gjøres kjent med at det er et slikt type system. Det er også krav til merking. De som tar i bruk KI-systemer som genererer innhold som kan defineres som en såkalt dyp forfalskning ( deepfakes ) , skal opplyse om at innholdet har blitt kunstig laget eller manipulert.

Virksomheter som tar i bruk KI-systemer, har videre plikt til å sikre tilstrekkelig kompetanse hos de som vil bruke eller drifte KI-systemene.

Dersom virksomheten innfører KI-baserte løsninger som også brukes utenfor Norges grenser må den uansett sette seg grundig inn i hva som gjelder – denne veilederen vil ikke dekke det tilfellet.

4.2.2 Risiko-klassifisering: Hva slags KI bruker dere?

Tabellen under viser risikoklassene. Selv om de fleste anvendelsene av en KI-assistent vil havne i klassen for begrenset eller minimal risiko, vil svært mange av de mest verdifulle og nyttige anvendelsene fort komme i klassen for høyrisiko.

Tabell 8 Risikoklasser ifølge KI-forordningen

|

Risikoklasse |

Beskrivelse |

Eksempler |

Krav |

|---|---|---|---|

|

Forbudt KI |

Systemer som anses som uakseptable grunnet brudd på grunnleggende rettigheter. |

Sosial poenggiving, manipulativ atferdsovervåking, biometrisk identifisering i sanntid i det offentlige rom (med visse unntak). |

Forbudt å utvikle, tilby eller bruke. |

|

Høyrisiko-KI |

KI brukt i områder som kan utgjøre en betydelig risiko for helse, sikkerhet eller grunnleggende rettigheter. |

Rekrutteringssystemer, kredittvurdering, helsehjelp, utdanning, kritisk infrastruktur og tilgang til grunnleggende velferdstjenester. |

Strenge krav til blant annet risikostyring, dokumentasjon, testing, loggføring, datakvalitet og -håndtering, gjennomsiktighet og informasjon til brukerne av systemet, menneskelig overblikk, nøyaktighet, robusthet og cybersikkerhet. Krav til å gjennomføre en FRIA for blant annet offentlige myndigheter. |

|

Begrenset risiko |

KI som samhandler med mennesker eller genererer eller presenterer innhold. |

KI-assistenter som oversetter mellom ulike språk, transkriberer fra tale til tekst, lager oppsummeringer, lager bilder, video, musikk, chatbots, virtuelle kundebehandlere. |

Krav til gjennomsiktighet (se over), bl.a. må informere brukeren om at de samhandler med et KI-system og merke innholdet på maskinlesbar form. |

|

Minimal risiko |

Enkle KI-løsninger uten vesentlig risiko for å bryte rettigheter. |

Stavekontroll, anbefalingsmotorer, enkle produktivitetsverktøy. |

Ingen særlige krav, men generelle krav om ansvarlig bruk kan fortsatt gjelde. |

Det avgjørende er bruksområdet og påvirkningen på enkeltpersoner, ikke om KI-systemet er avansert eller ikke.

I KI-forordningen er det et spesifikt krav til offentlige myndigheter som tar i bruk høyrisiko KI-systemer om at de blant annet må foreta en konsekvensvurdering av de grunnleggende rettighetene ( Fundamental Rights Impact Assessment – FRIA ). En «FRIA» skal blant annet inneholde beskrivelse av brukerens prosesser, hvor systemet skal inngå, periode, hyppighet, kategorier av personer eller grupper som blir påvirket av bruken, risiko for skade og tiltak, beskrivelse av hvordan mennesker skal overvåke systemet i henhold til bruksanvisningen m.m. En «FRIA» har dermed mye til felles med en personvernkonsekvensvurdering etter personvernforordningen. Det antas at EU vil komme med nærmere retningslinjer om hvordan FRIA-vurdering kan gjennomføres.

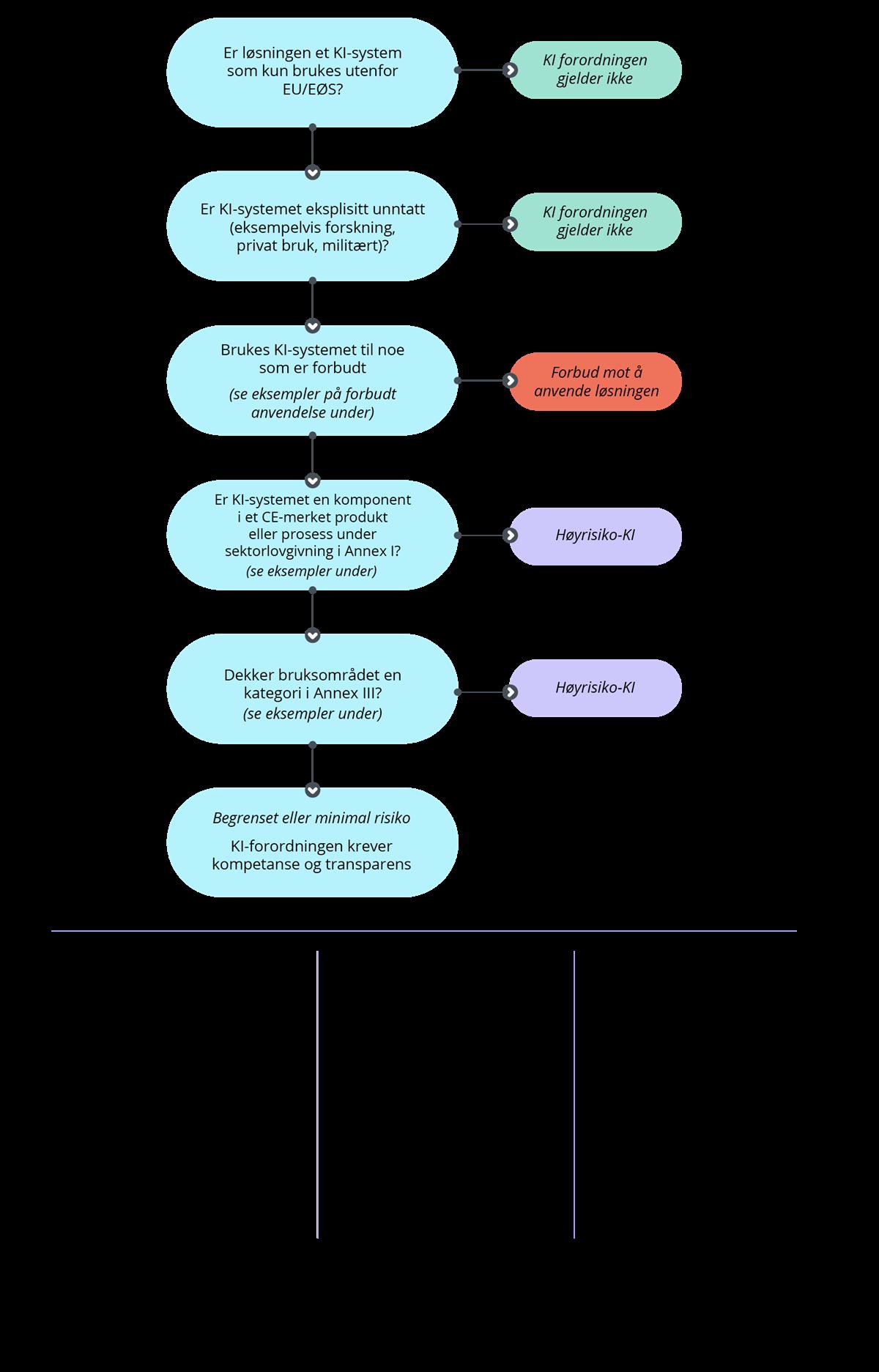

For å avgjøre om bruken av KI-assistenter anses som høyrisiko, kan du svare på spørsmålene i figur 2. I det tilfellet er det viktig at du tar kontakt med noen som kan bidra til å sikre samsvar med kravene i forordningen.

Figur 2 Vurdering av om et KI-system er høy-risiko ifølge KI-forordningen

4.2.3 Roller og ansvar: er dere idriftsetter eller leverandør av KI-systemet?

Hvilke plikter dere har, avhenger av rollen virksomheten har:

|

Rolle |

Hva betyr det? |

Eksempler på plikter |

|---|---|---|

|

Leverandør (provider) |

Utvikler eller ferdigstiller en KI-løsning for markedet. |

Fullt ansvar for å etterleve alle krav til dokumentasjon, testing, datasett, risikostyring mv. |

|

Idriftsetter (deployer) |

Bruker KI-løsning internt eller i egne tjenester |

Ansvar for at systemet brukes i tråd med formål, med risikovurdering og kontroll gjennom hele livsløpet. |

|

Distributør (distributor) |

Markedsfører eller videreselger en KI-løsning utviklet av andre. |

Må forsikre seg om at systemet er CE-merket og oppfyller regelverket. |

|

Importør (importer) |

Henter KI-løsninger inn fra land utenfor EU/EØS. |

Må sikre at systemet er i samsvar med kravene før det tas i bruk. |

Virksomheter som bruker generative KI-assistenter vil som hovedregel være idriftsettere ( deployers ) . Dersom virksomheten utvikler, videreselger eller tilpasser KI, kan de også bli leverandør, distributør eller importør – med større ansvar. Det er mulig å ha flere roller samtidig, noe mange ikke er klar over.

Vurdering av KI-assistert læringsplattform

Digital Norway har lansert en KI-assistert læringsplattform (Sana) og vurdert om denne er i tråd med KI-forordningen. Plattformen brukes til distribusjon av digitale kurs, åpent tilgjengelige for et eksternt publikum. KI-komponenten brukes for å tilby et mer tilpasset og engasjerende innhold til brukeren. Plattformen klassifiseres som lav risiko ettersom KI-funksjonene ikke benyttes til å vurdere prestasjoner eller tar beslutninger med konsekvenser for individet. Digital Norway har med denne løsningen to roller: som innholdsleverandør (provider) har de ansvar for faglig innhold og god informasjon til brukere; som idriftsetter (deployer) har de ansvar for at plattformens KI-funksjoner kan brukes på en forsvarlig måte.

Tiltak som Digital Norway gjorde: Innhentet dokumentasjon fra leverandøren om sikkerhet og etterlevelse av KI-forordningen (bl.a. ISO 27001, SOC 2, geo-gjerding, null-dagers datalagring). Forsikret seg at KI-funksjonene kun brukes som beskrevet i dokumentasjon fra leverandøren. Etablerte rutiner for menneskelig kontroll og løpende overvåking av KI-funksjon, og sikret god informasjon til brukere om at KI benyttes i leveransene.

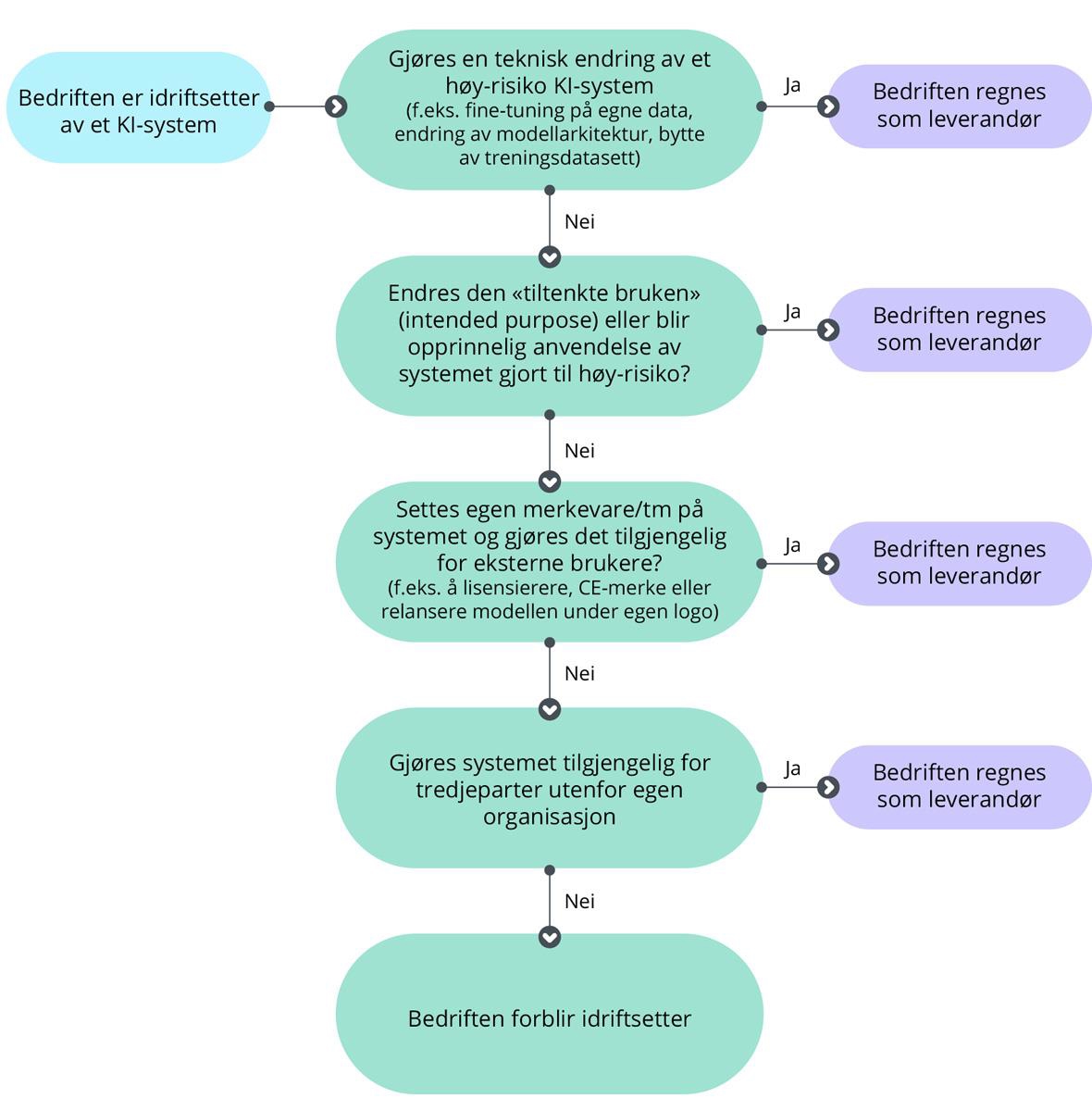

En indikasjon på om man er idriftsetter eller leverandør kan fås ved å svare på disse spørsmålene. Merk at dersom man regnes som leverandør, bør relevant fagekspertise kontaktes for å sikre samsvar med kravene i forordningen.

Figur 3 Vurdering av om virksomheten er idriftsetter eller leverandør av KI-systemer ifølge KI-forordningen

4.2.4 Eksempel på juridiske vurderinger for bruk av KI i kommuner

Kommuner leverer en rekke tjenester «fra vugge til grav» til innbyggere og næringsliv. Flere av tjenesteområdene kan potensielt bruke KI-assistenter til å forbedre eller effektivisere arbeidet, med ulik grad av menneskelig involvering.

Når KI brukes for å støtte avgjørelser som påvirker personers muligheter til f.eks. rett til utdanning, yrkesopplæring, karriere og tilgang til viktige tjenester innen helse og velferd, vil det etter KI-forordningen være høy risiko for at menneskers helse, sikkerhet og grunnleggende rettigheter kan bli berørt. KI-assistenter som tas i bruk av en kommune til disse formålene vil ofte klassifiseres som høyrisiko-systemer. Det er tillatt å ta i bruk KI-assistentene, men kommunen må overholde en rekke krav.

Dersom kommunen utvikler en høyrisiko KI-assistent og anses som leverandør , vil kommunen pålegges en del forpliktelser. Kommunen må etablere et kvalitetsstyringssystem som sikrer ivaretakelse av kravene i KI-forordningen. Dette innebærer blant annet krav til menneskelig overvåkning, datahåndtering og -styring, teknisk dokumentasjon, logging, gjennomsiktighet og informasjon til brukere, samt et system for risikostyring. Før kommunen kan ta i bruk en egenutviklet KI-assistent med høy risiko, må det gjennomføres en overenstemmelsesvurdering, systemet må CE-merkes og det må registreres i EUs database.

Dersom kommunen skal ta i bruk en ferdigutviklet KI-assistent, vil kommunen kunne anses som en idriftsetter . Kravene innebærer da blant annet å følge bruksanvisningen fra leverandør, sikre menneskelig tilsyn av personer med nødvendig kompetanse og informere ansatte hvis systemet skal brukes på arbeidsplassen.

4.3 Personvernforordningen

Bruk av data om enkeltindivider kan skape stor verdi for selskaper, men dersom bruken av en KI-assistent innebærer behandling av personopplysninger må virksomheten sørge for at behandlingen skjer i samsvar med kravene i personvernforordningen.

4.3.1 Roller og ansvar: Hvem gjør hva?

Hvis KI-assistenten behandler personopplysninger må virksomheten vurdere hvem som er behandlingsansvarlig og om eventuelle tredjeparter er databehandlere. I de fleste tilfeller vil virksomheten som bruker KI-verktøyet være behandlingsansvarlig fordi virksomheten bestemmer formålet med å ta verktøyet i bruk og midlene som benyttes. Leverandøren av KI-tjenesten opptrer da som databehandler, så lenge leverandøren kun behandler opplysninger på vegne av virksomheten.

Dersom leverandøren bruker dataene til egne formål, for eksempel for å forbedre modellen, vil leverandøren kunne være behandlingsansvarlig for den aktuelle behandlingen av personopplysninger. Dette må avklares eksplisitt i kontrakten med leverandøren.

4.3.2 Minimumskrav ved behandling av personopplysninger

I det følgende beskriver vi kort minimum av det som må være på plass for å behandle personopplysninger. Dette er ikke en uttømmende liste, men vil gi en pekepinn på hva som kreves. Vedlegget inneholder mer spesifikk informasjon, og det anbefales å søke juridisk kompetanse for å sikre at behandling av personopplysninger gjøres riktig.

Tabell 4.1 Krav ved behandling av personopplysninger

|

Krav |

Beskrivelse |

|---|---|

|

Databehandleravtale (DBA) er obligatorisk |

Gi leverandøren klare rammer for hva som behandles, hvorfor, hvordan det sikres, bruk av underleverandører og sletting ved avslutning. |

|

Ha kontroll på dataflyten ut av EØS |

Bruker leverandøren servere utenfor EØS, må overføringen hvile på et lovlig grunnlag (SCC, BCR eller unntak i art. 49). Vurder ekstra tiltak – kryptering eller pseudonymisering – for å møte Schrems II-kravene. |

|

Avklar om innsendte data brukes til modelltrening |

Dersom leverandøren trener videre på dine person- eller forretningsdata, kan det kreve nytt rettslig grunnlag og skape formålsutglidning. Sørg for skriftlig avtale og tydelig formålsbeskrivelse. |

|

Rettslig grunnlag og formålsbegrensning |

Før oppstart må du vite hvilke personopplysninger assistenten får se, hvorfor de behandles og hvilket lovlig grunnlag som brukes (samtykke, avtale, rettslig plikt mv.). Stramme tilgangskontroller hindrer at data brukes til andre formål. |

|

Automatiserte avgjørelser |

Hvis assistenten brukes til beslutninger som kan få vesentlig betydning for enkeltpersoner, må:

|

|

Medfører bruk av KI-assistenten høy risiko for enkeltpersoners rettigheter 5 ? |

Dersom dette er tilfelle må det gjennomføres en personvernkonsekvensvurdering (Data Protection Impact Assessment, DPIA) |

Eksempel: KI-assistent for oppsummering av samtaler til kundesenter

SpareBank 1 SMN har utviklet en KI-assistent som transkriberer og oppsummerer samtaler til kundesenteret, og automatisk legger oppsummeringene i CRM-systemet når samtalen er avsluttet. For å håndtere kundenes personvern best mulig lagres ikke samtalene lengre enn absolutt nødvendig for å utføre transkribering og oppsummering, før selve lydfilen slettes. Kundene informeres om at det brukes KI til å oppsummere samtalen når de ringer inn. De juridiske vurderingene, risikovurderingene og arbeidet med personvern var kompleks og tidkrevende, og involverte både nye avtaler med leverandører, innhenting av tilbakemelding fra kundene og en grundig DPIA. Hele prosessene med å få løsningen risikovurdert og godkjent gikk over en periode på 6 måneder.

Eksempel: Datatilsynets sandkasseprosjekt - NTNU og Copilot

NTNU gjennomførte i 2024 et prosjekt i Datatilsynets regulatoriske sandkasse om bruk av Microsofts Copilot. I Datatilsynets sluttrapport fremheves blant annet viktigheten av å gjennomføre en personvernkonsekvensvurdering. Rapporten understreker også behovet for god sikkerhet og orden i eget hus, spesielt når det gjelder tilgangsstyring og kontroll over personopplysninger. Tilsynet viser også til at Copilot kan stille avanserte vurderingsspørsmål basert på hele organisasjonens dokumenter, e-post og Teams-logger, og dermed kan brukes til å vurdere ansatte uten deres viten. Noen enkle tiltak for å bygge inn nødvendig tillit er å skru av funksjoner i KI-assistentene som rangerer eller scorer enkeltpersoner uten samtykke, og sikre ansattes innsynsrett og tilgang til å se logger og eventuelle «profiler».

Eksempel: Styringssystem for informasjonssikkerhet og personvern

Stavanger kommune har over lengre tid jobbet målrettet med å videreutvikle styringssystemet for informasjonssikkerhet og personvern. Hensiktsmessige styringsstrukturer er etablert på strategisk, taktisk og operativt nivå. På strategisk nivå inngår kommunedirektørens ledergruppe, på taktisk nivå inngår informasjonssikkerhetsrådet og på operativt nivå har kommunen etablert «Forum for systemansvarlige», «Ressursgruppen for personvern» og «Råd for digital etikk». Kommunen har definerte rolle- og ansvarsbeskrivelser i henhold til ISO 27001 og NSMs grunnprinsipper for IKT-sikkerhet. Hvert IT-system i kommunen har en systemeier og systemansvarlig med definerte oppgaver og ansvar knyttet til rollen. Det systematiske arbeidet med styringssystem gjør kommunen godt rustet til å tilpasse seg og håndtere ulike reguleringer av KI.

4.3.3 Automatiserte avgjørelser?

Det stilles særlig strenge krav og begrensninger når KI-systemer brukes til å fatte beslutninger uten menneskelig innblanding. Personvernforordningen artikkel 22 gir, med enkelte strenge unntak, enkeltpersoner rett til å ikke bli utsatt for avgjørelser som utelukkende fattes automatisk og som får rettsvirkning eller har vesentlig betydning for dem. Dersom systemet kun fungerer som beslutningsstøtte og gir anbefalinger til en saksbehandler som fatter den endelige avgjørelsen, gjelder ikke disse reglene i samme grad.

4.4 Øvrig regelverk du må forholde deg til i ulike roller

Det er ikke bare KI-forordningen og personvernforordningen som må vurderes ved bruk av KI. En rekke andre lover og forskrifter kan legge føringer eller sette skranker for hvordan KI-assistenter kan brukes eller utvikles i ulike virksomheter. Det er derfor viktig at hver enkelt virksomhet foretar en selvstendig vurdering av hvilke regelverk som er relevante i deres kontekst, og hvordan disse eventuelt begrenser eller regulerer bruken av KI, se også vedlegg C.

Nedenfor gis noen eksempler på områder der en særlig må være oppmerksomme på annet juridiske rammeverk ved implementering av KI-løsninger. Listen er ikke uttømmende, og den enkelte virksomhet må alltid gjøre konkrete vurderinger av sitt rettslige landskap og hvilke krav som gjelder.

4.4.1 Offentlige virksomheter

Virksomheter som er underlagt forvaltningsloven, offentlighetsloven, arkivloven og andre lover og regler som gjelder for offentlige virksomheter, har særskilte plikter og begrensninger ved bruk av KI.

Dette omfatter for eksempel krav til:

- Åpenhet og innsyn: Bruk av KI må ikke stå i veien for kravet om innsyn i saksdokumenter og beslutningsprosesser.

- Saksbehandling: Bruk av KI i saksbehandling må være i samsvar med prinsippene om rettssikkerhet, partenes rettigheter og krav til forsvarlig saksbehandling. Automatiserte avgjørelser kan ha særskilte regler.

- Arkivering og dokumentasjon: Informasjon produsert eller brukt av KI må håndteres i tråd med arkivloven og gjeldende arkivforskrifter, herunder krav til sporbarhet og dokumentasjon.

4.4.2 Rolle som arbeidsgiver

Når KI benyttes i arbeidsrelaterte sammenhenger, som rekruttering, overvåking, medarbeideroppfølging eller intern kommunikasjon, må virksomheten ta hensyn til arbeidsrettslige og personvernrettslige krav, for eksempel:

- Personvern og samtykke: I tillegg til kravene i personvernlovgivningen finnes det særskilte regler som beskytter ansatte i arbeidslivsammenheng og som kan sette skranker for bruken av KI. Herunder finnes det særregler i arbeidsmiljøloven og tilhørende forskrift om innsyn i e-postkasse mv. som kan utfordres ved bruken av KI.

- Diskriminering og rettferdighet: Likestillings- og diskrimineringsloven oppstiller regler som forbyr diskriminering, også indirekte diskriminering som kan oppstå ved skjevheter i KI-systemer brukt i rekruttering eller vurdering.

- Medbestemmelse og informasjon: Arbeidsmiljøloven samt hovedavtalen i arbeidslivet krever at arbeidsgiver drøfter med tillitsvalgte ved innføring av nye teknologier som kan påvirke arbeidsmiljøet. Se for øvrig kapittel 3.3.

- Arbeidsmiljø og overvåking: Bruk av KI for overvåking må vurderes opp mot regler om personvern og arbeidstakers rettigheter, særlig med hensyn til proporsjonalitet og formål.

- Enhver virksomhet innen helse- og omsorg er pålagt å tilby faglig forsvarlige helse- og omsorgstjenester og god pasientsikkerhet. 6

4.4.3 Virksomheter som håndterer nasjonal sikkerhet og kritisk infrastruktur mv.

Virksomheter som håndterer nasjonal sikkerhet, kritisk infrastruktur og annen samfunnsviktig informasjon – slik som forsvar, energi, transport, helse, vannforsyning, finans og digital infrastruktur – må forholde seg til særlige regelverk:

- Sikkerhetsloven og tilhørende forskrifter stiller krav til sikkerhetsstyring, beskyttelse av sikkerhetsgradert informasjon og kontroll med tilgang til kritiske systemer.

- Digital sikkerhetslov (og kommende NIS2) og andre sektorspesifikke regler stiller krav til cybersikkerhet og hendelseshåndtering for kritiske tjenester.

Bruken av KI-assistenter må vurderes nøye opp mot sikkerhetskravene for å unngå sårbarheter og risiko for lekkasje av gradert informasjon eller svekkelse av kritisk infrastruktur. Det kan også være krav om sertifisering eller godkjenning av teknologiske løsninger som benyttes i kritiske systemer.