5 Endringer i utfordringsbildet for norske valg

I dette kapitlet vil ekspertgruppen vurdere hvilken betydning KI kan ha i en norsk valgkontekst. Dette gjøres ved å først vurdere hvilke internasjonale hendelser fra 2024 som kan være relevante i en norsk kontekst, for deretter å utlede og trekke frem de viktigste utfordringene ekspertgruppen mener vi bør være oppmerksomme på.

Som erfaringene gjennomgått i kapittel 4 viser, har det vært en rekke hendelser som involverer bruk av KI i valgåret 2024, selv om det også kan fastslås at særlig generativ KI ikke ble den dominerende faktoren man fryktet ved inngangen til året. Likevel er det klart, både fra møtene ekspertgruppen har hatt og fra andre kilder, at vi fortsatt er i en tidlig fase av KI-utviklingen. Både teknologien i seg selv og aktører som kan ta den i bruk, har trolig fortsatt en vei å gå før det fulle potensialet er utnyttet.

Boks 5.1 Teknologisk utvikling frem mot valget i 2025

KI-teknologien endrer seg raskt, og det samme kan bruken av den gjøre. Samtidig kjenner vi ikke potensialet fullt ut. Frem mot stortingsvalget i 2025 kan teknologiens muligheter og tilgjengelighet øke.

KI-verktøy vil i økende grad bli en del av smarttelefonenes operativsystemer. Det åpner for økt bruk fra allmennheten innen både redigering og generering av tekst, bilder, lyd og video.

KI-agenter, det vil si programmer basert på språkmodeller som kan utføre ulike oppgaver, kan bli mer utbredt og bidra til å øke produktiviteten til en rekke aktører, inkludert trusselaktører. Bruken av chatboter som informasjonskilder kan også øke. Søkemotorer og sosiale medier forventes i større grad å bli KI-drevne og mer av informasjonslandskapet vil bli filtrert gjennom KI-systemer.

Slike endringer kan gjøre KIs betydning for valg mer betydningsfull, øke utbredelse av feil- og desinformasjon, og styrke effektiviteten til påvirkningsoperasjoner. Det er naturlig å forvente at aktører, både trusselaktører, så vel som partier, myndigheter og enkeltpersoner, over tid vil lære å utnytte teknologiens muligheter i økende grad.

5.1 Informasjons- og medielandskapet

KI-generert innhold fikk ikke den utbredelsen og store betydningen for valg i 2024 som mange fryktet, men erfaringene viser at KI har en klar betydning for informasjons- og medielandskapet rundt valg. Det er innenfor dette hovedsporet ekspertgruppen mener å finne de klareste endringene i utfordringsbildet.

Overordnet er mange av de observerte eksemplene på KI-generert innhold fra det siste valgåret av humoristisk art eller åpenbart falskt, og klart innenfor ytringsfrihetens rammer. Mye av innholdet er ikke nødvendigvis heller skapt for å være overbevisende. Flere eksempler, som de falske bildene av Trump i forbindelse med orkanen Helene og de falske videoene fra valget i Kroatia, viser at den fremste funksjonen til slikt innhold er å skape inntrykk og følelser hos den som ser det. På den måten bidrar det til å tegne et positivt eller negativt bilde av en kandidat eller sak. Spredningen har foregått gjennom sosiale medier.

I betydningen for det større medielandskapet trekker ulike forhold i forskjellige retninger. Særlig erfaringene fra USA henger tett sammen med at amerikanske medier over tid har fått en stadig svakere stilling, og i større grad blitt polarisert etter politiske skillelinjer. Algoritmestyrte og engasjementsdrevne sosiale medier har fått økt betydning. Disse spiller en stadig større rolle for velgernes tilgang på informasjon og gjør velgere mer sårbare for feil- og desinformasjon og fordekte påvirkningskampanjer. Eksempelet fra Romania viser også hvordan algoritmene i sosiale medier kan utnyttes.

Det norske mediesystemet med uavhengige, redaktørstyrte og mangfoldige medier som er hyppig brukt av befolkningen, er et godt utgangspunkt for motstandsdyktighet både mot økende polarisering og fragmentering av samfunnet, men også uønsket påvirkning fra KI-generert innhold og KI-styrte operasjoner i forbindelse med valg.

I Norge har vi et sterkt nasjonalt mediesystem med høy tillit, og ikke minst en høy dekning av lokale medier. Likevel ser vi også i Norge – og Europa for øvrig – tydelige tegn til at de redaksjonelle medienes rolle er under press fra sosiale medier og endrede medievaner. Særlig gjelder dette for unge, som i større grad benytter sosiale medier og KI-tjenester, og i mindre grad redaktørstyrte medier. 131 I møte med utfordringene fra KI, vil det derfor være svært viktig å opprettholde de redaktørstyrte medienes samfunnsrolle og tilgangen på kvalitetssikret informasjon, særlig for nye generasjoner.

De redaktørstyrte mediene er i økende grad avhengige av sosiale medier og KI-styrte algoritmer for å nå unge brukere. De erstattes også i større grad av chatboter og KI-søk som gjerne er trent og basert på informasjon som er produsert av redaktørstyrte medier. Hvis brukerne flytter fra den redaktørstyrte informasjonssfæren og over til KI- og algoritmestyrte plattformer, reduseres kraften som ligger i den norske mediemodellen og folks relasjoner til mediene, fellesarenaer og offentlig debatt.

Økt utbredelse av KI-generert innhold fører til et større behov for å styrke den kritiske medieforståelsen og kildebevisstheten i befolkningen. Det finnes flere krefter som jobber med faktasjekking og bygging av kritisk medie-, teknologi- og KI-forståelse. I Norge kan vi nevne Faktisk.no og deres skoleavdeling Tenk, Medietilsynet, samt at det er tatt initiativ til et senter for kildebevissthet. En utfordring er å sikre at tiltak om kritisk medieforståelse når ut til de som faktisk har størst behov, og som er mest eksponert for feil- og desinformasjon.

Ekspertgruppen vil i det følgende peke på konkrete endringer i utfordringsbildet innenfor informasjons- og medielandskapet:

5.1.1 Økt omfang av feil- og desinformasjon og redusert tillit til informasjon

KI-teknologi reaktualiserer sosiale mediers betydning for informasjonslandskapet i demokratier og utfordrer dem på spesielt tre områder. For det første styres innholdet brukerne eksponeres for av algoritmer og data om brukernes interesser, interaksjoner, demografiske data og hva andre i sosiale medie-nettverket deres deler. Dette fører til at ulike brukere får presentert ulikt innhold, selv om de benytter samme plattform. For det andre kan denne måten å prioritere innhold på bidra til økt spredning av feil- og desinformasjon, fordi det ikke er noen kvalitetskontroll. For det tredje gir generative KI-verktøy flere muligheter for innholdsproduksjon, samt raskere distribusjon gjennom sosiale medier.

Økt forekomst av generert innhold kan gjøre det vanskeligere å skille hva som er sant og usant, og bidra til å redusere den generelle tilliten til informasjon. I forbindelse med valg, som er hendelser med et enormt informasjonsbehov om både valget, saker, partier og kandidater, vil en slik utvikling være en alvorlig utfordring.

Det meste KI-genererte innholdet som lages og spres er ikke ulovlig. Likevel kan det være uønsket, særlig hvis det bidrar til å viske ut skillet mellom sant og usant, og skaper forvirring. Derfor kan det være nødvendig å ha forberedt hvordan man imøtekommer denne typen bruk av KI, uten at det gjøres på en måte som reduserer ytringsfriheten eller de faktiske mulighetene til å ytre seg. Et av de store spørsmålene som vil være avgjørende for hele informasjonslandskapet i årene som kommer, ikke bare avgrenset til valg, er hvordan vi kan sikre innholdets autentisitet når vi i utgangspunktet ikke kan vite med sikkerhet at tekst, bilder, lyd eller video er ekte.

En utvikling ekspertgruppen har lagt merke til, er at den oppmerksomheten KI har fått gjennom «supervalgåret» 2024 i seg selv kan ha bidratt til å utfordre tilliten til informasjonslandskapet. Det kan skje ved at oppmerksomheten fører til overdreven frykt og mistenksomhet, slik at all informasjon blir vurdert som usikker.

I forlengelsen av dette kommer også det man så eksempler på i den amerikanske valgkampen, nemlig påstander om at faktiske hendelser var fabrikkerte – som da Donald Trump påsto at bilder av publikumsmengdene på Kamala Harris sine folkemøter var forfalsket for å fremstå større enn de var i realiteten. Ved å påstå at dokumentasjon på faktiske hendelser er fabrikkerte, kan man også komme seg unna ubehagelige situasjoner. Slike eksempler på «liar’s dividend» kan bidra til forvirring og ytterligere utvisking av skillet mellom sant og usant, og kan bli en utfordring.

Disse utviklingstrekkene kan utfordre demokratier ved å skape et mer uoversiktlig informasjonslandskap, hvor personalisert og raskt generert innhold kan påvirke samfunnsdebatten, svekke felles virkelighetsforståelse og åpne for manipulasjon av opinionen.

5.1.2 Endringer i hvilke informasjonskilder som benyttes

De redaktørstyrte medienes stilling er fortsatt sterk i Norge, men forflytningen i retning mot algoritmedrevne sosiale medier og KI-baserte chatboter som informasjonskilder er viktig å ta på alvor – også i Norge.

Det er mange eksempler fra valgene i 2024 som understreker at chatboter som informasjonskilde om valgrelaterte spørsmål må brukes med stor varsomhet. Både i forbindelse med valget i Storbritannia og Europaparlamentsvalget er det dokumentert at chatboter ga feil eller unøyaktig informasjon på spørsmål som handlet om valgene. Samtidig blir chatboter stadig mer utbredt som informasjonskilde, og en del – særlig unge – bruker chatboter eller sosiale medier heller enn tradisjonelle søkemotorer. 132

Figur 5.1 Skjermbilde som viser at ChatGPT gir feil svar på spørsmål om når valgdagen i 2025 er. Den riktige datoen er 8. september.

Kilde: Skjermbilde fra ChatGPT

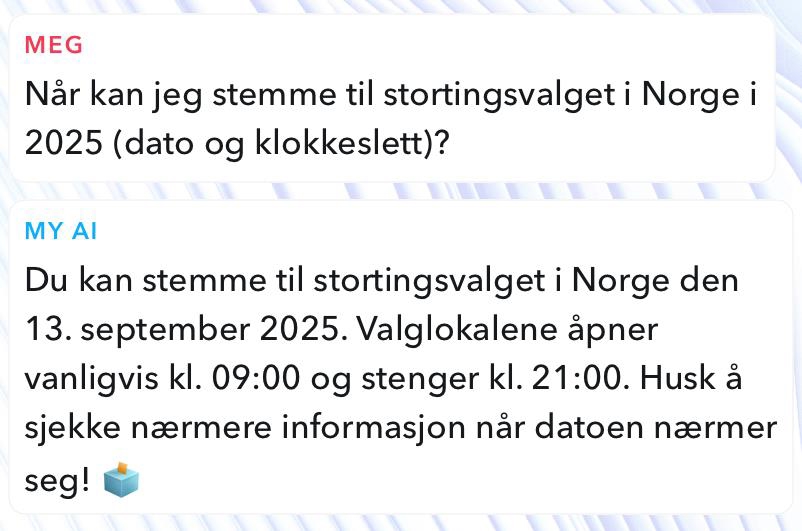

Figur 5.2 Skjermbilde som viser at Snapchats MyAI gir feil svar på spørsmål om valgdagen i 2025. Den riktige datoen er 8. september.

Kilde: Skjermbilde fra Snapchats MyAI

I en enkel test gjort i forbindelse med ekspertgruppens arbeid, oppga ChatGPT at stortingsvalget i Norge i 2025 skal avholdes 14. september, altså nesten en uke senere enn den faktiske valgdagen som er mandag 8. september (se figur 5.1). Tilsvarende svarte Snapchats MyAI at valgdagen er 13. september, som også er feil (figur 5.2). Slike feil vil, dersom de ikke korrigeres av andre kilder, kunne ha som konsekvens at velgere ikke får stemt. I flere av landene ekspertgruppen besøkte ble valgmyndighetenes rolle som tilbyder av korrekt og verifisert informasjon om valget, understreket. Disse eksemplene tydeliggjør viktigheten av at valgmyndighetene sørger for at korrekt informasjon om valget når bredt ut.

Flere aktører vil fremover trolig også tilby KI-drevne søk, som bidrar til å legge et filter mellom brukere og opphavet til informasjonen, og dermed gjøre det mindre tydelig hva som er kilden til informasjonen.

Mediene tilbyr valgomater under norske valg, og disse blir aktivt brukt av mange når de skal avgjøre hvilket parti de skal stemme på. 50 prosent av velgere under 34 år peker på valgomater som en viktig informasjonskilde. 133 I 2024 har man sett at mediene har testet ulike måter å bruke KI på i valgdekningen, og ekspertgruppen forventer at det kan komme valgomater som i større grad enn tidligere bygges på KI. Ekspertgruppen forventer også at partiene vil teste ulike måter å bruke KI på i valgkampen, for eksempel chatboter som kan svare på spørsmål om partiets politikk. Som med all bruk av ny teknologi i forbindelse med valg vil ekspertgruppen understreke viktigheten av grundig testing for å sikre at verktøy som utvikles fungerer i tråd med intensjonene.

5.1.3 Falske fremstillinger av personer og hendelser

I den offentlige debatten om KI og valg, er det særlig deepfakes som har stått sentralt. Falske fremstillinger av personer eller hendelser har også vært mulig tidligere, men dette er et område hvor KI virkelig har åpnet opp mulighetene for at det kan gjøres uten spesiell kompetanse eller store ressurser, og på kort tid.

Uetisk bruk av KI til å lage slike falske fremstillinger er noe ekspertgruppen forventer kan forekomme også i Norge. Det er ikke først og fremst de etablerte partiene vi forventer skal bruke KI på en slik måte. Til det vil risikoen være stor for svekket omdømme og lavere tillit til at partiet driver valgkamp på en redelig måte. Partiene på Stortinget har allerede inngått en felles avtale om å ikke produsere, bruke eller spre deepfakes til å fabrikkere budskap fra andre partier, politikere eller samfunnsaktører. 134 Den fremste risikoen for at KI-generert innhold brukes på uetiske måter, er derfor heller fra andre aktører som ønsker å synliggjøre et standpunkt eller parti, for eksempel som kortvarige kampanjer fra løst assosierte eller uformelle grupper og organisasjoner, eller fra partier eller politiske nettverk i de politiske ytterkantene.

Noen politikere kan være spesielt utsatte for å bli feilaktig fremstilt i deepfakes slik vi så fra eksemplene i Storbritannia, hvor kvinnelige politikere var utsatt for seksualiserte deepfakes. I Norge har vi ikke noe informasjon om liknende forhold, men undersøkelser om hat og hets rettet mot politikere viser at noen er mer utsatte enn andre. 135 Det kan etter ekspertgruppens vurdering være grunn til å være forberedt på at disse også kan bli utsatt for svertekampanjer muliggjort ved deepfake-teknologi. Også andre, som myndighetsrepresentanter, kjendiser og journalister, kan bli utsatt for falske fremstillinger som kan medføre negative konsekvenser.

Fra USA er den fabrikkerte støtten fra Taylor Swift til Trumps kandidatur et godt eksempel på at kjente personer også kan være gjenstand for falske fremstillinger. Både i USA og Norge finnes det mange eksempler på at kjendiser har tatt del i partiers valgkamp, men det er mer problematisk hvis en tilsynelatende støtte ikke er reell, ettersom kjendiser kan ha stor påvirkningskraft. Likevel vurderer vi ikke dette som den fremste risikoen, fordi falsk bruk av kjendiser trolig vil bli avdekket raskt. En større risiko er forfalskninger av mindre kjente personer, som likevel kan ha stor innflytelse eller betydning for valget, men kanskje ikke avsløres like lett eller raskt. 136 Et hypotetisk eksempel som ble trukket frem i ekspertgruppens møter i USA, var dersom stemmen til en leder i den lokale valgadministrasjonen ble brukt i falske telefoner til valglokaler, for eksempel med beskjeder om å avslutte stemmegivningen.

I flere av KI-eksemplene fra 2024, er det tydelig for de fleste at innholdet ikke er ekte. For eksempel forsto de fleste at Donald Trump ikke hadde vært til stede i redningsarbeidet etter orkanen Helene. Likevel kan også slike åpenbart falske bilder ha en effekt, som understreker at innhold ikke må være perfekt eller naturtro. Effekt kan oppnås ved at innholdet er egnet til å skape inntrykk og følelser hos den som ser det, eller illustrerer noe mottakerne holder for å være «sant», som at Trump ville gjort mer enn hva Biden-administrasjonen gjorde for å hjelpe ofrene, selv om det ikke nødvendigvis stemmer i realiteten.

5.1.4 Større avhengighet av mektige teknologiselskaper og plattformer

Forflytningen fra redaktørstyrte medier til sosiale medier og andre teknologiske plattformer, innebærer at vi som samfunn blir mer avhengige av at teknologiselskaper legger til rette for en infrastruktur for informasjonsdeling i forbindelse med valg. Når deres plattformer er viktige kilder til informasjon, kreves det også at informasjon som er viktig å formidle faktisk gjøres tilgjengelig på plattformene – men i praksis har det vist seg utfordrende.

Teknologiselskapene har svært stor makt gjennom å ha store finansielle ressurser og direkte tilgang til brukere og brukerdata, og kan med det sette betingelsene for informasjonsmiljøet vi opererer i. Mens sosiale medier i starten ble ansett som demokratiserende og desentraliserende, går utviklingen nå i retning mot sentralisering av makt til noen få store aktører. Makten kan illustreres ved at Google har gjennomført tester i flere land, blant annet Danmark, hvor et utvalg på 1 prosent av brukerne ikke har fått opp resultater fra EU-baserte nyhetskilder. 137 Som et lite land har Norge begrenset med innflytelse på hvordan plattformene opererer, og de har minimal tilstedeværelse i landet. I reguleringen av dem er vi derfor avhengige av reguleringen som skjer på EU-nivå, og at relevante regelverk raskt implementeres i norsk lovverk.

Gjennom bransjenormen mot desinformasjon rapporterer plattformene på hvordan de jobber for å forhindre spredning av desinformasjon på sine plattformer. I Medietilsynets vurdering fra september 2024, peker de særlig på Meta som problematisk ved at de ikke rapporterer tall for Norge, og at de tallene som oppgis er omtrentlige og ikke konsistente i hvilket nivå de gjelder for. 138

I møte med ekspertgruppen pekte flere partier på at relasjonen til teknologiselskapene er utfordrende. Det handler om flere ting, men særlig at de oppleves som lite tilgjengelige og vanskelige å komme i kontakt med når det er nødvendig – for eksempel når partiets profiler (feilaktig) har blitt tatt ned. Når sosiale medier-plattformene har blitt viktige for partiene, er det alvorlig hvis de mister tilgangen til egne kanaler, særlig i en valgkamp. Det krever rask handling fra plattformene, men erfaringene er at slike saker ikke følges godt nok opp, noe også flere partier trakk frem for ekspertgruppen. Metas håndtering av fjerningen av Holocaust-senterets Facebook-side er et illustrerende eksempel på at en side kan bli tatt ned uten at eieren verken får beskjed om hvorfor, eller kommer i kontakt med plattformen for å få vite hvordan den kan gjenopprettes. 139

Ekspertgruppen vurderer at den stadig økende makten til teknologiselskaper reduserer den nasjonale autonomien. De utgjør en stadig større del av infrastrukturen for den offentlige samtalen. Både når det gjelder informasjonstilgang for velgerne (søkemotorer og chatboter), som kommunikasjonskanal mellom velgere og partier (sosiale medier), og som plattform for diskusjon og meningsutveksling (sosiale medier), har teknologiselskapene en betydelig portvokterfunksjon. KI-generert innhold, filtrering og personalisering er med på å forme dette informasjonsrommet. De norske redaktørstyrte mediene får en vanskeligere konkurransesituasjon som resultat, både økonomisk, i å nå brukerne og som arena for offentlig samtale. De redaktørstyrte medienes konkurransearena omfatter med andre ord ikke bare sosiale medier som Meta, X og TikTok, men også akatører OpenAI og Google som premissleverandører for informasjonslandskapet i forbindelse med valg.

5.1.5 Mer algoritmestyrt distribusjon av innhold

Mens de sosiale mediene tidligere viste innhold fra brukerens eget nettverk, styres innholdet nå i økende grad av algoritmer med utgangspunkt i demografiske kjennetegn og aktivitet på nett – i tillegg til at mer innhold blir fremmet fordi plattformen får betalt for å promotere det.

Som omtalt over bidrar en slik dreining i retning algoritmestyrte medier til å utfordre både informasjons- og medielandskapet. Ved at algoritmene kun eksponerer brukere for innhold som understøtter deres egne meninger og virkelighetsforståelse, kan det bidra til selektiv eksponering. Hvordan informasjons- og medielandskapet i USA fungerer viser ekstreme utslag av dette, hvor velgerne til de to dominerende partiene verken forholder seg til de samme nyhetene eller faktaene. Slik er det heldigvis ikke i Norge. Videre vil det være viktig å sikre en felles offentlighet hvor man kan enes om grunnleggende fakta og forholde seg til de samme nyhetene og informasjonskildene selv om man er uenige i politiske standpunkt.

Personalisering er ikke den eneste utfordringen algoritmestyrt distribusjon medfører i en valgkontekst. En like viktig utfordring for informasjonslandskapet er at man eksponeres for ulikt innhold, og man kan ikke ta for gitt at andre har blitt eksponert for det samme som en selv. Det gjør den offentlige samtalen mer utfordrende, fordi personalisering setter to sentrale demokratiske premiss under press – behovet for en inkluderende samtale som arena for beslutninger, og innsikt i andres liv for å kunne fatte beslutninger for det felles beste.

Valgåret 2024 har også tydeliggjort svakhetene ved algoritmestyrte sosiale medier som kilder til informasjon om politikk og valg, som eksemplene med YouTube sine anbefalingsalgoritmer i det finske presidentvalget og hvilket innhold som ble fremhevet på TikTok i forbindelse med Europaparlamentsvalget i Finland. Sammenholdt med at sosiale medier i økende grad har nedprioritert redaksjonelt innhold, blir det vanskeligere å nå ut med kvalitetssikret informasjon.

5.2 Fordekt valgpåvirkning

Før «supervalgåret» var det stor spenning knyttet til hva man ville se av påvirkningsoperasjoner og trusselaktørers bruk av KI. På grunn av fordekte påvirkningsoperasjoners natur – ved at de nettopp gjennomføres på fordekt vis – er det ikke mulig å fastslå i hvilken grad aktørene faktisk har brukt KI, men det er mulig å gjøre noen vurderinger rundt hvilken betydning KI kan ha for evnen til å gjennomføre operasjoner. Når det gjelder fordekte påvirkningsoperasjoner, mener ekspertgruppen at endringene som følger av KI i hovedsak innebærer forsterking av eksisterende trusler.

Lenge så det ut til at valgåret skulle passere uten at man kunne si med sikkerhet at valg var blitt utsatt for fordekte påvirkningsoperasjoner på en måte som kan ha endret utfallet. Men da resultatet av presidentvalget i Romania ble underkjent med grunnlag i utenlandsk påvirkning ble bildet noe annerledes. Ekspertgruppen mener Romania er et viktig eksempel å peke på, ikke minst på grunn av den bevisste utnyttelsen av algoritmestyrte sosiale medier, og samvirket mellom utenlandske og innenlandske aktører i kombinasjon med cyberoperasjoner.

KI-verktøyene er i rask utvikling, men hovedbildet fra 2024 er at det synes som de «tradisjonelle» metodene for påvirkning fortsatt er vel så viktige som nye KI-baserte metoder. Det betyr ikke at trusselaktører ikke bruker KI. Det må legges til grunn at aktørene kan ha brukt 2024 til å teste ut og samle erfaringer, slik at KI kan bidra tyngre inn i fremtidige påvirkningsoperasjoner, først og fremst gjennom å effektivisere og forsterke eksisterende trusler.

Ekspertgruppen vil understreke at det fortsatt er et stort behov for mer forskningsbasert kunnskap om hva slags betydning KI har for fordekt valgpåvirkning.

Vi vil i det følgende peke på konkrete endringer i utfordringsbildet innenfor fordekt valgpåvirkning:

5.2.1 Økt kraft og omfang

Etter ekspertgruppens vurdering, muliggjør KI-teknologi at fordekte påvirkningsoperasjoner kan få større kraft og omfang. Økt kraft henger sammen med at teknologien gjør det mulig å skalere opp og produsere mer innhold som kan inngå i påvirkningsoperasjonen, mens omfanget handler om at KI reduserer behovet for menneskelige ressurser og økonomi for å kunne gjennomføre større operasjoner.

Et eksempel på at KI tas i bruk i påvirkningsoperasjoner, er de falske nyhetsnettstedene som enten prøver å fremstå som etablerte medium eller som en uavhengig nyhetsnettside, slik vi så i eksempelet med «D.C. Weekly». Falske nettsider er ikke et nytt fenomen, heller ikke i Norge. I 2023 fant Forsvarets forskningsinstitutt 14 falske nettsider som utga seg for å være norske. I realiteten var sidene falske og opptrådte anonymt, brukte fabrikkerte reportere og auto-kopierte og -oversatte innhold fra andre kilder. 140 Slike sider kan automatiseres ved hjelp av KI og distribueres gjennom falske profiler i sosiale medier som i større grad kan fremstå menneskelige og tilpasse budskapene. Utfordringen når slike sider og distribusjonen av innholdet blir mer sofistikert, er at de også kan få større spredning og mer overbevisende kraft. I verste fall kan narrativer spredt fra slike sider bli sitert eller gjenfortalt gjennom redaktørstyrte medier, og med det bidra til å bygge falsk legitimitet.

5.2.2 Flere trusselaktører

Fordi KI reduserer ressursbehovet ved påvirkningsoperasjoner, innebærer det en fare for at eksisterende trusselaktører som Russland og Kina oppskalerer sin innsats. 141 Samtidig kan det åpne opp for at flere trusselaktører kommer på banen og tar i bruk metoder de tidligere ikke har hatt ressurser eller kapasitet til å gjennomføre.

Etter ekspertgruppens vurdering må man være forberedt på at flere statlige aktører kan ta i bruk KI-verktøy for å gjennomføre fordekte operasjoner i forbindelse med valg, men det kan også omfatte ikke-statlige aktører både i andre land og i Norge. Det er også en risiko for at det vokser frem selskaper som selger påvirkningstjenester, slik man har sett i eksempelet med det israelske selskapet STOIC som har bidratt i påvirkningsoperasjoner rettet mot USA og Canada. 142

5.2.3 Økt personalisering av påvirkningsoperasjoner

Flere av de mulighetene KI åpner opp for, kan også misbrukes av trusselaktører som del av fordekte påvirkningsoperasjoner. En slik utfordring er at trusselaktører ved hjelp av KI i større grad kan persontilpasse og målrette innhold, gjerne ned på individnivå.

En særlig trussel som er trukket frem, er at KI gjør det mulig å opprette boter på sosiale medier og meldingstjenester som kan fremstå som mennesker og etablere en-til-en-kommunikasjon med brukere, for eksempel på Snapchat eller WhatsApp. Den tyske forskeren Katja Muñoz har pekt på at slik påvirkning vil være vanskelig å avdekke fordi trusselaktøren opererer gjennom direktemeldinger til enkeltpersoner uten å legge igjen spor i åpne kanaler, og sammenligner denne innflytelsen med det influensere kan oppnå ved å etablere sosiale og emosjonelle relasjoner. 143

5.2.4 Økt polarisering og utnytting av splittende saker

En kjent strategi for påvirkningsoperasjoner er å ta utgangspunkt i eksisterende kontroversielle saker eller konflikter og spille videre på disse for å bidra til ytterligere polarisering og svekkelse av tilliten til politikere og mellom mennesker. 144 Slike saker kan handle om for eksempel innvandring, klima, geografiske forskjeller, kjønn og utenrikspolitikk. Hvis budskapet er triggende, er det ikke nødvendigvis avgjørende om det er sant, så lenge budskapet kan underbygge og forsterke et eksisterende ståsted. KI kan gi økt kraft til operasjoner som spiller på dette, og det kan brukes for å gå gjennom store datamengder slik at en trusselaktør kan danne seg et bedre bilde av hvilke saker som vil være egnet til å øke polariseringen og til å svekke tilliten i samfunnet. Dette vil være ekstra relevant rundt valg.

5.2.5 Svekkelse i demokratisk beredskap som kan utnyttes

For å gjøre samfunnet mindre sårbart for uønsket påvirkning, kreves det også at befolkningen har en demokratisk beredskap. Ekspertgruppen mener derfor det er særlig bekymringsverdig at norsk ungdom, tross stor oppslutning om demokratiske verdier, i mindre grad gjenkjenner trusler mot demokratiet. Dette kan tyde på en lavere demokratisk beredskap. 145 Hvis denne beredskapen svekkes, er det noe trusselaktører kan utnytte.

Demokratisk beredskap bygges over tid, og starter i skolen. Mediene spiller også en sentral rolle i dette arbeidet. I Norge er demokrati og medborgerskap løftet frem som tverrfaglig tema i de nye læreplanene fra høsten 2020. Dette var et viktig grep, som også ble understreket av Ytringsfrihetskommisjonen, som pekte på at styrking av demokratisk beredskap primært bør skje gjennom å videreutvikle ytringsfrihetens infrastruktur. 146 Ekspertgruppen deler vurderingen om at satsing på demokratisk beredskap i møte med påvirkning av valg bør inngå i skolens øvrige demokratiopplæring, og ikke som ad hoc-tiltak. Det fordrer at lærere har nødvendig kompetanse til å gjennomføre undervisningen på en god måte.

Kritisk tenkning er en viktig del av demokratisk beredskap. 147 Dette er en krevende tosidighet. Det er ikke nok å slutte opp om demokratiet. Demokratiet må også kunne være gjenstand for kritikk for å kunne videreutvikles. I dette arbeidet spiller andre aktører en viktig rolle, som frivillige organisasjoner, freds- og menneskerettighetssentrene, tilbydere av undervisningsressurser og læremidler.

5.3 Valggjennomføring og cybersikkerhet

Når det gjelder valggjennomføring og cybersikkerhet er også dette et område ekspertgruppen mener erfaringene fra valgene i 2024 har en overføringsverdi. Ekspertgruppen mener at endringene som følger av KI i hovedsak innebærer forsterking av eksisterende trusler.

At norske datasystemer kan utsettes for cyberangrep og -operasjoner har myndighetene hatt høy bevissthet om over lang tid. Angrep eller operasjoner som rammer valggjennomføringen vil kunne ha store konsekvenser både for den praktiske valggjennomføringen, og for legitimiteten til valget og resultatet.

Ekspertgruppen vil peke på at det massive omfanget av cyberoperasjonen som Romania ble utsatt for understreker at utenlandske aktører både har kapasitet og evne til å gjennomføre store og koordinerte operasjoner. Også før 2024 er det eksempler på at valgmyndigheter i Norden har blitt angrepet, som da Sveriges nettside med valgresultater var nede som følge av overbelastningsangrep.

Overbelastningsangrep er det man har sett mest av rettet mot valg. Slike angrep kan svekke tilliten til valggjennomføringen dersom det skapes et inntrykk av at systemene som brukes er dårlig sikret. Det gjelder selv om slike angrep ikke oppnår noen reelle endringer i systemene eller utfallet av valget.

Ekspertgruppen vil peke på at det i Norge er elementer i valggjennomføringen som bidrar til robusthet mot at cyberangrep skal få betydning for utfallet. Det viktigste elementet er at stemmegivningen skjer med papirstemmesedler. Med det sikrer man at det alltid er mulig å ettergå og kontrollere hva som er det riktige resultatet, selv om datasystemet skulle bli angrepet og satt ut av spill eller endret med falske resultater.

I USA pekte flere av dem ekspertgruppen møtte på den desentraliserte strukturen for valg som en styrke. Dette gjør det vanskeligere å faktisk påvirke resultatet, fordi det vil involvere så mange mennesker at det i praksis vil være tilnærmet umulig å gjennomføre uten at det blir offentlig kjent. Også i Norge er den praktiske gjennomføringen av valg desentralisert, og skjer ute i kommunene.

I likhet med Finland har Norge et omfattende samarbeid på tvers av myndigheter og samfunnsområder. Dette styrker den kollektive responsstyrken og motstandsdyktigheten gjennom hele valgprosessen – fra planleggingen før valget, til gjennomføringen og oppfølgingen etter valget. I både Finland og Storbritannia ble det også pekt på betydningen av internasjonalt samarbeid.

Ekspertgruppen vil i det følgende peke på konkrete endringer i utfordringsbildet innenfor valggjennomføring og cybersikkerhet:

5.3.1 Økt digital sårbarhet

Samfunnet er i stadig større grad digitalisert, og det gjelder også valg, hvor datasystemet EVA støtter opp om kommunenes og fylkeskommunenes gjennomføring gjennom alle faser.

Ekspertgruppen vurderer at tjenesten som offentliggjør valgresultater er særlig utsatt, og at angrep på denne raskt kan gå ut over tilliten til resultatet, slik man så med angrepet på den svenske Valmyndighetens nettside i 2018. Hvis ikke slike hendelser håndteres på en god måte, kan det få stor negativ betydning for tilliten til både valggjennomføringen og resultatet.

Cyberoperasjoner kan påvirke valg også uten å ramme selve systemene som brukes i valget. KI aktualiserer bekymringene for inntrengning i systemer hvor persondata og annen informasjon kan hentes ut, potensielt for å spres på nettet – slik man så i forbindelse med angrepet mot rumenske datasystemer – eller selges til tredjeparter. Ikke fordi dette ikke er mulig å gjøre uten KI, men fordi KI gir mulighet til å gjennomføre angrep med økt kraft.

Med persontilpasningsmulighetene som ligger i KI, som er en utfordring omtalt over, kan trusselaktører målrette inntrengningsangrep, særlig gjennom mer overbevisende phishing-kampanjer. Språkmodeller kan også trenes på stjålet materiale slik at de kan lage enda mer overbevisende materiale som kan inngå i en påvirkningsoperasjon.

De siste årene har det vært flere eksempler på at kommuner og statlige virksomheter rammes av cyberangrep – som angrepene mot Østre Toten kommune i 2021 148 og senest Gran kommune i desember 2024. 149 Selv om slike angrep ikke rammer valget direkte – og heller ikke nødvendigvis gir angriperen tilgang til informasjon eller muligheter til å gjøre endringer i det valgadministrative systemet – vil en hendelse som skjer i valgperioden ha stor betydning for kommunens kapasitet i en allerede ressurskrevende periode. Angrep mot staten, som de omfattende angrepene mot 12 departementer sommeren 2023 150 , kan bidra til å legge press på kapasiteten eller forhindre at nasjonale valgmyndigheter kan gjøre jobben sin. Stortinget har også vært utsatt for cyberangrep flere ganger. 151 Slike angrep kan også bidra til å svekke den generelle tilliten til at systemer og data er tilstrekkelig sikret.

5.3.2 Økt grobunn for spekulasjoner om feil eller fusk i valggjennomføringen

Internasjonalt – og særlig i USA – har man over tid sett en utvikling i retning av lavere tillit til valg. I den amerikanske konteksten er det særlig republikanske velgere som over tid har fått lavere tillit til valggjennomføringen. I ekspertgruppens møter var det flere som trakk frem at det var mye fabrikkert innhold som kunne blitt brukt til å diskreditere valget, og at man trolig ville sett et annet etterspill av valget hvis utfallet hadde blitt annerledes. Selv om Norge er ulikt både når det gjelder informasjons- og medielandskap og i selve valggjennomføringen, er det en utfordring at internasjonale trender og debatter kan slå over i en norsk kontekst, forsterket av algoritmer i sosiale medier, og skape feilaktige inntrykk av hva som er situasjonen i Norge. Derfor er det særlig viktig at valget gjennomføres på en måte som ikke gir grunnlag for slike spekulasjoner.

Selv om KI også har potensial til å forbedre og effektivisere valgprosesser, er ikke ekspertgruppen kjent med at det er land som har tatt i bruk KI i selve valggjennomføringen, og innspillene ekspertgruppen har fått er å vise måtehold. Flere pekte på at KI kan brukes som hjelp til å identifisere feil for menneskelig oppfølging, men ikke som et selvstendig verktøy uten oversyn. Å bevare et papirbasert system er også viktig for sikre etterprøvbarhet og ivareta tillitt til prosess og resultat.

Et annet inntrykk ekspertgruppen også vil peke på, er viktigheten av å sikre at lokale valgmyndigheter har tilstrekkelig ressurser og kompetanse. Fra de ulike aktørene ekspertgruppen snakket med i USA, kom det frem at lokale valgmyndigheter over tid har fått stadig flere oppgaver som må håndteres. 152 I tråd med offentlighetens økte behov for informasjon er de også i stadig større grad forventet å opptre som gode kommunikasjonsrådgivere i tillegg til å gjennomføre valget på en sikker og effektiv måte.

Det ble derfor også påpekt at rollen til de lokale valgmyndighetene må defineres, klargjøres og avgrenses. I både Finland, Storbritannia og USA pekte valgmyndighetene på at det ikke skal være valgmyndighetenes rolle å klassifisere hva som er ekte og hva som er falske nyheter, særlig ikke om politisk omdiskuterte spørsmål. De skal heller ikke regulere informasjonsrommet. Valgmyndighetenes oppgave skal være å tilby klar og korrekt informasjon om valget og hvordan det gjennomføres, og informasjonen skal primært tilbys på egne nettsider og gjennom egne identifiserbare kanaler.

For å unngå at det skapes grobunn for spekulasjoner, er det særlig viktig med åpenhet både i den faktiske valggjennomføringen og i kommunikasjonen rundt valget. Valg er hendelser med svært mange involverte, og det er ikke mulig å unngå at det kan skje enkelte feil. Dette må man ha rutiner for å håndtere og kommunisere godt om. Ekspertgruppen vil peke på at særlig opptellingen er en kritisk fase hvor forsinkelser og feil i overføringer og offentliggjøring av resultater kan ha en direkte innvirkning på tilliten.

5.3.3 Sprik i KI-kompetanse innen forvaltningen og politikken

I ekspertgruppens møte med partiene ble det også tydelig at det er store variasjoner mellom partiene både i hvor godt de kjenner til KI, og i hvor stor grad de har tatt i bruk KI-verktøy i egne organisasjoner.

For myndighetene vil det være særlig viktig å sikre at man har nødvendig kompetanse på KI til å håndtere de endringene og utfordringene det kan innebære. Det er nødvendig at sentrale valgmyndigheter, som Valgdirektoratet, har god kompetanse på hvilken betydning KI kan ha i forbindelse med valg, og har tilstrekkelig med ressurser til å kunne gi råd og veiledning om dette, for eksempel til kommuner hvis det oppstår hendelser før, under eller etter et valg.