4 Erfaringer fra valg gjennomført i 2024

En sentral del av ekspertgruppens mandat har vært å kartlegge erfaringer fra andre land som gjennomførte valg i løpet av 2024. Kartleggingen innebærer hva landene har gjort i forkant av valget for å forberede seg på at KI kan bli benyttet på en uønsket måte, om det har vært hendelser i forbindelse med valget som innebærer bruk av KI og håndteringen av hendelsene, samt om KI er vurdert å ha hatt noen betydning for valggjennomføringen eller -resultatet.

Kartleggingen bygger på informasjon innhentet på tre måter. For det første gjennom studieturene ekspertgruppen har gjennomført til Finland, Storbritannia, Belgia og USA. For det andre bygger den på innspill fra norske utenriksstasjoner. Alle ambassader og faste delegasjoner fikk i august en bestilling fra Utenriksdepartementet på vegne av ekspertgruppen, hvor de ble bedt om å orientere om KI og valg i sine respektive land. Hvilke utenriksstasjoner som har sendt orienteringer fremgår av vedlegg 1. For det tredje bygger kartleggingen på offentlige rapporter fra bl.a. forskningsinstitusjoner, teknologiselskaper og tenketanker, samt medieoppslag.

Ekspertgruppen har lagt særlig vekt på de store valgene i Europa og USA i 2024, ettersom dette er valg som gjennomføres i land med lange demokratiske tradisjoner hvor erfaringene i større grad kan ha relevans også i en norsk kontekst. I det følgende kapitlet gjennomgås derfor sentrale valg ekspertgruppen har undersøkt, i tillegg er det tatt inn enkelte interessante funn og eksempler fra andre land. På tampen av ekspertgruppens arbeidsperiode ble valget i Romania gjennomført, som skulle vise seg å bli det mest dramatiske eksempelet i 2024. Det er kun valg som er gjennomført i 2024 som er omtalt, derfor er ikke det mye omtalte valget i Slovakia omtalt her – og eksempelvis heller ikke valgene i Argentina eller Nigeria, da alle disse ble gjennomført i 2023.

Ekspertgruppen tar forbehold om at det kan være hendelser som ikke er fanget opp av denne kartleggingen, og det tas heller ikke sikte på å omtale alle hendelser i forbindelse med valg hvor KI har spilt en rolle. Fokuset i det følgende kapitlet er å få frem erfaringer fra ulike land, hvordan de har tilnærmet seg denne nye utfordringen og trekke frem enkelte illustrerende eksempler.

Som en forberedelse til valgåret 2024 gikk en rekke teknologiselskaper i februar 2024 sammen om en avtale om å bekjempe falske nyheter og spore opp KI-generert politisk innhold, kalt Munich Tech Accord. 71 Gjennom denne avtalen skrev selskaper som blant annet Microsoft, Google, Meta, TikTok, Snap, OpenAI, X og flere andre under på å jobbe for å forhindre skadelig KI-generert innhold som kan villede velgere.

4.1 Romania

Første runde av Romanias presidentvalg ble gjennomført 24. november, men valgresultatet ble annullert kun kort tid før andre runde skulle avholdes. 72 Annulleringen skjedde etter anklager om omfattende utenlandsk påvirkning som angivelig stammer fra Russland. Russland har selv benektet å ha gjennomført påvirkningsoperasjoner rettet mot det rumenske valget. 73 Påvirkningen skal ha skjedd gjennom promotering av russisk-vennlige kandidater som er skeptiske til NATO. Det har vært mye oppmerksomhet rundt hvordan kampanjen kort tid før valget bidro til at den ytterliggående ganske ukjente presidentkandidaten Călin Georgescu plutselig seilte opp som vinner av første valgrunde.

Det er mye som fortsatt ikke er kjent fra hendelsene i Romania, blant annet om bruken og omfanget av KI. Ekspertgruppen mener dette valget fremstår som det mest dramatiske eksempelet fra 2024, med anklager om påvirkningsoperasjoner som kombinerte cyberangrep, desinformasjon i sosiale medier og utnyttelse av algoritmer for å maksimere spredning. Hendelsene under valget i Romania illustrerer hvordan de tre hovedsporene ekspertgruppen har identifisert i kapittel 3, informasjons- og medielandskap, fordekt valgpåvirkning og cybersikkerhet, kan samvirke for å forsterke trusler mot demokratiske valg.

Georgescus kampanje skjøt fart på TikTok like før første valgrunde. Ifølge Digital Forensic Research Lab (DFRLab), en del av NGO-en Atlantic Council, var veksten i antall følgere på 2 541 prosent, og det var også enorm vekst i likerklikk, kommentarer og delinger. Totalt anslår de at han hadde til sammen 1,4 milliarder visninger på TikTok globalt. 74 Telegram ble brukt for å koordinere kampanjen.

For å fremme kandidaten har aktøren utnyttet et smutthull i TikToks regelverk mot politisk reklame ved at influensere har blitt betalt for å dele innhold som bidro til å øke Georgescus synlighet, selv om de ikke nødvendigvis nevnte ham ved navn. 75 Disse influenserne oppga ikke sine bindinger til kandidaten. I tillegg til TikTok, har det også blitt avdekket mangler i Metas moderering av politisk reklame i forbindelse med det rumenske valget. 76

Rumenske myndigheter ba TikTok om å slette Georgescu-relatert innhold fire dager før første valgrunde, da innholdet ikke var i tråd med regelverket for åpenhet om finansieringskilder under valgkampen. TikTok påstod at de hadde blokkert rumenske brukere fra disse postene. Likevel viser dokumentasjonen at rumenske brukere fortsatt hadde tilgang på valgdagen, som er et brudd på valgloven. Denne forskjellsbehandlingen økte Georgescus eksponering på bekostning av andre kandidater.

I etterkant av valget har EU åpnet sak mot TikTok på grunn av hendelsene i det rumenske valget. 77

I tillegg til bruk av sosiale medier, ble rumenske IT-systemer for valg utsatt for kraftige angrep. Etterretningstjenestene identifiserte 85 000 cyberangrep mot det rumenske IT-systemet for valget. Målet var trolig å få tilgang til data, endre innhold, samt å knele systemene. Angrepene fortsatte i flere dager, inkludert på valgdagen og påfølgende dag. Angrepene kom fra 33 ulike land, og påvirkningsforsøkene er vanskelig å attribuere til en spesifikk aktør.

Innloggingsinformasjon til nettsider for det rumenske valget ble lagt ut på en russisk illegal cyberplattform, samt på en privat Telegramkanal som er kjent for å spre stjålne data fra statlige aktører.

Ekspertgruppen vil understreke at det fortsatt pågår undersøkelser av hva som skjedde i forbindelse med det rumenske valget, og at det kan ha kommet ny informasjon etter at rapporten ble skrevet. Selv om det er uklart i hvilken grad KI var en del av bildet i Romania, er hendelsene illustrerende for hvordan påvirkning av valg kan skje blant annet ved å bruke algoritmestyrte sosiale medier.

4.2 Finland

Finland gjennomførte presidentvalg 28. januar (første runde) og 11. februar (andre runde). Som et nordisk land har Finland mange likhetstrekk med Norge – blant annet en utstrakt velferdsstat, relativt høyt tillitsnivå og et mangfoldig medielandskap med sterke redaktørstyrte medier. Samtidig har Finland en geopolitisk situasjon som skiller seg fra Norges. Finland har en lang grense mot Russland, og ble medlem av NATO først i 2023.

Ekspertgruppen besøkte Finland høsten 2024 og møtte ulike aktører for å danne seg et inntrykk av valget. Det klare inntrykket er at (generativ) KI ikke spilte noen stor rolle i presidentvalget.

4.2.1 Forberedelser før valget i Finland

Ekspertgruppen har ikke inntrykk av at KI i seg selv var en stor del av finske myndigheters forberedelser før valget, men at det inngikk i det helhetlige arbeidet med å sikre valg. I dette arbeidet ble samarbeid mellom ulike aktører særlig trukket frem, og det er etablert en arbeidsgruppe på tvers av sektorer som jobber med sikkerhet i valg.

Fra valgmyndighetenes side ble det understreket at deres rolle ikke er å klassifisere ekte eller uekte nyheter, men sikre at det gis klar og korrekt informasjon om hvordan valget gjennomføres, og være tilgjengelig for å svare på spørsmål om dette. I tilfelle den offentlige tekniske løsningen som rapporterer valgresultater til presse og offentlighet skulle gå ned som følge av angrep eller tekniske problemer, finnes det en reserveløsning plassert i et annet miljø. Et viktig poeng i de finske forberedelsene var at denne reserveløsningen skulle ha et tilnærmet likt design som den originale for å unngå spekulasjoner eller mistillit, slik man så i Sverige under deres valg i 2018. Da ble den svenske Valmyndighetens nettside utsatt for et overbelastningsangrep, som førte til påstander om valgfusk fordi det var tydelige forskjeller i enkelte partiers oppslutning når siden kom opp igjen sammenlignet med før den ble tatt ned. 78

4.2.2 Hendelser og erfaringer fra valget i Finland

Finske velgere kan be om å få telle opp stemmer på nytt. Det har vært en økning i antallet som ønsker dette, men det er ikke mulig å fastslå om økningen skyldes lavere tillit eller andre forhold. At all stemming skjer på papir ble trukket frem som en styrke i så måte, fordi det sikrer at opptelling kan skje på en transparent og allmenn forståelig måte.

Selv om Finland har sterke medier som når ut bredt, har også sosiale medier fått en større plass i valgkampen og som arena for politisk diskusjon. I ekspertgruppens møter med aktører i Finland, ble det pekt på at særlig partiene på ytre høyre var aktive på sosiale medier. De rettet seg spesielt mot yngre velgergrupper som i mindre grad følger nyhetene gjennom de redaktørstyrte mediene. En studie gjort i forbindelse med det finske valget så nærmere på anbefalingsalgoritmene i YouTube, og fant en overrepresentasjon av anbefalinger for høyresiden. Anbefalingene så ut til å særlig fremme videoer knyttet til partiet Sannfinnene og deres kandidater, og forskerne mener det tyder på skjevheter i algoritmen. 79

Hendelser i Finland i forbindelse med Europaparlamentsvalget er omtalt i punkt 4.3.2.

4.3 Valg til Europaparlamentet

Valg til Europaparlamentet ble gjennomført i perioden 6.–9. juni 2024 i alle EUs 27 medlemsstater. I praksis er ikke valget til Europaparlamentet ett valg, fordi valget gjennomføres i hvert enkelt land, med de respektive landenes egne valglover som utgangspunkt. Fra EUs side er det kun lagt noen få overordnede føringer for hvordan representantene skal velges. 80

4.3.1 Forberedelser før Europaparlamentsvalget

I forkant av valget var det en bekymring for hva KI kunne bety, særlig for feil- og desinformasjon. EU har gjort en bred innsats for å forberede seg selv og de enkelte medlemslandene, som strekker seg videre enn kun valget alene. Europaparlamentet har pekt på fire hovedområder for denne innsatsen: 81

- Utvikle politikk for å styrke demokratiet, gjøre det vanskeligere for trusselaktører å misbruke digitale plattformer og beskytte journalister og mediemangfoldet.

- Bygge bevissthet om desinformasjon og EUs beredskap og respons.

- Bygge samfunnsmessig motstandskraft mot desinformasjon gjennom kritisk medieforståelse og faktasjekking.

- Samarbeid med andre institusjoner, nasjonale myndigheter eller tredjeparter.

I tillegg til tiltak satt inn i forbindelse med valget, kommer også relevant regulering som EU har vedtatt gjennom blant annet DSA og KI-forordningen, som bidrar til at de store teknologiselskapene, herunder plattformleverandører og søkemotorer, pålegges aktiv innholdsmoderering og lignende krav, som omtalt i kapittel 2.

Eksempler på tiltak som ble iverksatt fra EUs side, inkluderer blant annet informasjon om hvordan frie og hemmelige valg sikres på Europaparlamentets nettsider om valget, videoer på ulike språk som skal opplyse om teknikkene som brukes av trusselaktører for å spre desinformasjon, og en «verktøykasse» for lærere om hvordan man kan avdekke og motvirke desinformasjon. EUs utenrikstjeneste (EEAS) har også etablert en egen tjeneste som kontinuerlig følger med på og avslører desinformasjonskampanjer, kalt EUvsDisinfo.eu. På denne nettsiden, som ikke er avgrenset til Europaparlamentsvalget, offentliggjøres avdekkede påvirkningskampanjer fortløpende.

Alle partigruppene i Europaparlamentet signerte i forkant av valget en avtale (Code of Conduct), der de blant annet skrev under på at partiene skulle bidra til å sikre etisk og transparent bruk av kampanjeverktøy og teknologi, inkludert KI. Videre skrev partiene under på at de ikke skulle benytte villedende innhold, uavhengig av om den er generert av KI eller ikke, for å forfalske kandidater eller andre aktører i et valg. Avtalen slo også fast at bruk av innhold generert av KI kun skulle brukes med tydelig merking. 82 Avtalen var frivillig og ikke-bindende, men det lå likevel en forventning om at partiene og politikerne skulle følge den ut fra lojalitetshensyn. Avtalen omfattet kun politiske partier på europeisk nivå og de nasjonale partiene som aktivt signerte den.

Ekspertgruppen har ikke noen samlet oversikt over tiltak som ble iverksatt i de enkelte medlemslandene, men er kjent med at både Frankrike 83 og Latvia 84 har innført lover som regulerer bruk av deepfakes blant annet i forbindelse med valg. Ekspertgruppen er imidlertid ikke kjent med hvilke erfaringer som er gjort med slike lover, eller om det har blitt reist saker med grunnlag i dem.

4.3.2 Hendelser og erfaringer fra Europaparlamentsvalget

Basert på ekspertgruppens informasjon om Europaparlamentsvalget, er det ikke grunnlag for å konkludere med at KI hadde en så stor betydning for valget som mange fryktet på forhånd. En rapport fra European Board for Digital Services konkluderer med at tiltakene for å sikre beredskap og koordinering var vellykkede, og at det ikke ble avdekket noen større eller systematiske tilfeller av desinformasjon som forstyrret valget. 85 Fra EU-kommisjonens foreløpige gjennomgang av kjente påvirkningsoperasjoner, rapporteres det at KI i liten grad har blitt benyttet i desinformasjonskampanjer. I ukene før valget ble det funnet at omtrent 4 prosent av all desinformasjon som ble undersøkt og faktasjekket var KI-generert. Politiske partier har benyttet KI i begrenset omfang. Likevel viser erfaringene fra valget både bredden av bruksområder for denne teknologien og dens potensial for manipulasjon. 86

The Alan Turing Institute gjennomførte en kartlegging av hendelser hvor desinformasjon eller deepfakes basert på KI hadde gått viralt i forbindelse med Europaparlamentsvalget og det franske parlamentsvalget samlet. Totalt i disse to valgene avdekket de kun 11 slike tilfeller, langt færre enn mange hadde fryktet på forhånd. 87 Siden det er snakk om «virale» hendelser, innebærer dette tilfeller som har fått en betydelig oppmerksomhet og spredning.

Ekspertgruppen er ikke kjent med at valgmyndigheter verken på EU-nivå eller i de enkelte landene har tatt i bruk KI i eget arbeid i forbindelse med valggjennomføringen.

Feilinformasjon fra chatboter

I forbindelse med valget gjorde Democracy Reporting International en undersøkelse av hvordan fire populære chatboter svarte på spørsmål om Europaparlamentsvalget. De konkluderer med at ingen synes å ha slagside mot noen av partiene eller sidene i politikken, men at ingen av dem var i stand til å gi korrekt informasjon om selve valggjennomføringen, altså om når valget avholdes eller hvordan man stemmer. 88 Også en test gjort av faktasjekkere i Correctiv fant at chatboter ga feilaktig informasjon om kandidater og fabrikkerte kilder. 89

Forsterking av negative saker i sosiale medier

I forbindelse med Europaparlamentsvalget gjorde forskere fra Finland en undersøkelse av hvordan TikTok presenterte politisk informasjon i perioden før valget. 90 For brukere som søkte informasjon, inneholdt søkeresultater krenkende språkbruk om kvinner og minoriteter, og hadde også skjevheter ved å fremheve omtrent bare negativt innhold om enkelte politikere. Forskerne vurderer at TikToks søkeresultater kan ha bidratt til å forme hva de som søker etter informasjon her ser, og til å opprettholde fordommer. Et annet funn i samme undersøkelse er at innhold fra kandidater som handler om kontroversielle saker i innenrikspolitikken hadde større sannsynlighet for å bli fremmet i anbefalinger, mens innhold om sikkerhet og naturbeskyttelse i liten grad ble fremmet. Merking av valgrelatert innhold var også inkonsistent.

KI-generert innhold fra ytre høyre

I eksemplene på bruk av KI-generert innhold i valgkampen før Europaparlamentsvalget, er det særlig ytre høyre-partier som peker seg ut med å ha laget eller bidratt til å spre falskt innhold.

I Frankrike delte partiet Rassemblement National (Nasjonal Samling) flere KI-genererte bilder. Gjennom en kampanje de kalte «L’Europe Sans Eux» («Europa uten dem») ble det spredt KI-genererte bilder som ble brukt til å illustrere saker som blant annet handlet om å stoppe innvandring og hijabbruk. 91 Flere partier på ytre høyre brukte KI-genererte bilder som en del av sin kampanjestrategi. 92

Også den franske nettsiden til det europeiske partiet Identitet og Demokrati, et av partiene som hadde signert avtalen om bruk av KI, publiserte KI-genererte bilder av migranter, som videre ble delt i partiets kanaler i sosiale medier. Partiet la også ut flere sponsede innlegg (annonser) som besto av videoer med KI-generert innhold. En av disse hevdet at Europa står foran en «alarmerende migrasjonskrise» og inneholdt ni genererte bilder som skulle forestille migranter, EU-flagget og EU-institusjoner, protester og eksplosjoner. Ifølge Meta Ad Library, gjengitt av DFRLab, fikk videoen en rekkevidde på 29 406 på Facebook og Instagram. 93

Figur 4.1 Eksempler på KI-generert innhold fra kampanjen «L’Europe sans eux!». Ekspertgruppens merking.

Kilde: Schueler et al. 2024

I Italia benyttet Matteo Salvini, medlem av Europaparlamentet og leder av partiet Lega, generativ KI under årets Europaparlamentsvalg. Salvini er kjent for sin motstand mot EU-integrasjon. Bildene var ikke merket som KI-genererte, og dermed i strid med partiene i Europaparlamentet sin avtale om KI-bruk. Et av de KI-genererte bildene viste en gravid person med skjegg og teksten «mindre Europa», og på motsatt side en tilsynelatende heteronormativ familie med to barn og teksten «mer Italia». Bildet ble blant annet brukt i en Facebook-reklame, som antas å ha kostet mellom 4 500 og 5 000 euro med en rekkevidde på tre millioner brukere. Salvini publiserte også flere lignende bilder, blant annet ett som fremstilte den franske presidenten Emmanuel Macron i en militæruniform med et EU-flagg på skulderen. 94

Selv om Salvini og hans parti Lega ikke var forpliktet etter avtalen gjort mellom partiene i Europaparlamentet, har det vært reaksjoner på Salvinis bruk av KI-genererte bilder. Kritikken retter seg hovedsakelig mot bruken av KI i politisk kommunikasjon, deres valgkampstrategier og bruken av KI-generert innhold uten tilstrekkelig merking eller åpenhet. Enkelte brukere på X har påpekt at slike strategier kan undergrave tilliten til politiske budskap og forsterke splittelser i samfunnet.

Figur 4.2 Eksempel på KI-generert innhold publisert på Matteo Salvinis Instagram-profil. Ekspertgruppens merking.

Kilde: Skjermbilde fra Instagram, @matteosalviniofficial 23. mai 2024

I Tyskland gjennomførte partiet Alternativ for Tyskland (AfD) annonsekampanjer på Facebook og Instagram. Minst tre av disse skal ha vært manipulert ved bruk av generativ KI. Et av bildene viser en hvit kvinne med synlige kroppsskader og teksten: «sammenhengen mellom migrasjon og kriminalitet har blitt benektet i årevis». 95

Falske nettsider

Aktiviteten i den prorussiske Doppelganger-operasjonen (se omtale i boks 3.1) tiltok i perioden frem mot Europaparlamentsvalget, også med innhold om selve valget. I forkant av valget ble det avdekket falske versjoner av kjente nyhetsmedier som Die Welt, Le Parisien, Polskie Radio og flere andre. 96 OpenAI har avdekket at personer tilknyttet Doppelganger-operasjonen har brukt deres verktøy til å generere kommentarer på ulike språk til sosiale medier, til å oversette og redigere artikler som ble postet på nettsider, til å generere overskrifter og til å omgjøre saker til Facebook-innlegg. 97

4.4 Storbritannia

Storbritannia gjennomførte parlamentsvalg 4. juli 2024. Bruken av generativ KI under valget var begrenset, og forholdsvis få eksempler ble registrert.

Til tross for en økning i digital valgkamp siden forrige valg, er inntrykket at de politiske partiene i Storbritannia fokuserte mest på tradisjonelle valgkampmetoder. De redaktørstyrte mediene står fortsatt sterkt, men tilliten til mediene er på vei ned. For de yngre generasjonene og deres nyhetskonsum, erfarer man at de trekkes mot sosiale medier.

4.4.1 Forberedelser før valget

Som en del av risikovurderingen før valget, inviterte Storbritannias valgkommisjon (UKEC) til dialog med blant annet Microsoft, OpenAI og sosiale medier-aktører, hvor hensikten var å forstå hvordan aktørene ville legge opp sitt arbeid før valget. Dialogen har likevel ikke hatt noen formalisert form. Det betyr i praksis at plattformene i stor grad kan avgjøre om de vil ta innspill til følge, og har definisjonsmakt til å avgjøre hva som skal regnes som desinformasjon i en valgkontekst.

National Cyber Security Centre (NCSC) startet forberedelsene ett år før valget ble avholdt. Som en del av forberedelsene var scenarioplanlegging, risikoanalyser, dataskraping i sosiale media, identifisere hull i datasystemer, og veiledning og støtte til politiske kandidater. Det ble også identifisert et sett med velgerprofiler, som kunne gi retning til diskusjoner, men også en indikasjon på hvordan ulike personer responderer ulikt på digitalt innhold. I tillegg forberedte NCSC hvordan de kunne håndtere hack and leak-operasjoner , som var innrettet mot e-post-systemer og brukerkontoer.

Et av de konkrete fokusområdene var å styrke beredskapen mot målrettede kampanjer rettet mot befolkningsgrupper som effektivt kunne dele feilinformasjon om valget, og kampanjer som med hensikt kunne forsterke splittelse i samfunnet.

Aktører som ekspertgruppen møtte i Storbritannia viste også til at det pågår løpende arbeid for å styrke befolkningens kritiske medieforståelse, politiske kompetanse og kunnskap om valggjennomføringen. Slik kompetanse ble vist til som særlig viktig for å bidra til at KI-generert innhold ikke skal få spredning eller bidra til at velgere blir lurt av falskt innhold eller falske påstander.

4.4.2 Hendelser og erfaringer fra valget i Storbritannia

The Alan Turing Institute fant 16 bekreftede og virale tilfeller av KI-generert desinformasjon eller deepfakes under det britiske parlamentsvalget. Blant de konkrete truslene som aktualiseres av KI, fremhever de svertekampanjer, villedende politisk reklame, velgermålretting, parodisk og satirisk innhold, KI-genererte informasjonskilder og feilaktig tilskrivning av KI. 98

Under det britiske valget dukket det opp flere tilfeller av parodiske deepfakes som kunne oppfattes som ekte. Det finnes også eksempler på innhold som befinner seg i gråsonen mellom satire og desinformasjon, slik som en KI-generert lydforfalskning av Labours statsministerkandidat Keir Starmer som angivelig skjelte ut medarbeidere. Dette falske lydklippet ble raskt avslørt og fikk lite spredning og oppmerksomhet.

Det var også forekomster av trakassering og svertekampanjer rettet mot politikere. Enkelte kvinnelige politikere ble utsatt for svertekampanjer hvor KI-verktøy var brukt for å lage pornografiske fremstillinger. 99 Deepfakes kan få betydning selv om de har blitt avkreftet. Dette gjelder også falske lydklipp. Ordfører i London, Sadiq Khan, har uttalt at en KI-generert lydforfalskning ble en stor belastning for ham. 100

Ytre høyre-aktivisten Tommy Robinson delte et bilde på X for å diskreditere Keir Starmer og Labour, der han brukte et generert bilde som skulle illustrere at partiet ikke lenger sto på arbeidernes side. 101

Figur 4.3 KI-generert bilde delt av ytre høyre-aktivisten Tommy Robinson på X. Ekspertgruppens merking.

Kilde: Skjermbilde av KI-generert bilde lagt ut på X av @TRobinsonNewEra 10. juni 2024

I møtene ekspertgruppen hadde i Storbritannia ble det pekt på at chatboter hadde gitt feil svar på spørsmål om valget, for eksempel om ID-krav for å stemme. At chatboter ikke alltid ga korrekte svar om valget bekreftes også av en undersøkelse fra Reuters Institute som viser at en betydelig andel av svarene fra chatbotene enten var helt eller delvis feil. 102 Flere aktører pekte også på utvikling av opphavsmerking av innhold som et viktig tiltak for å øke troverdigheten til sann informasjon.

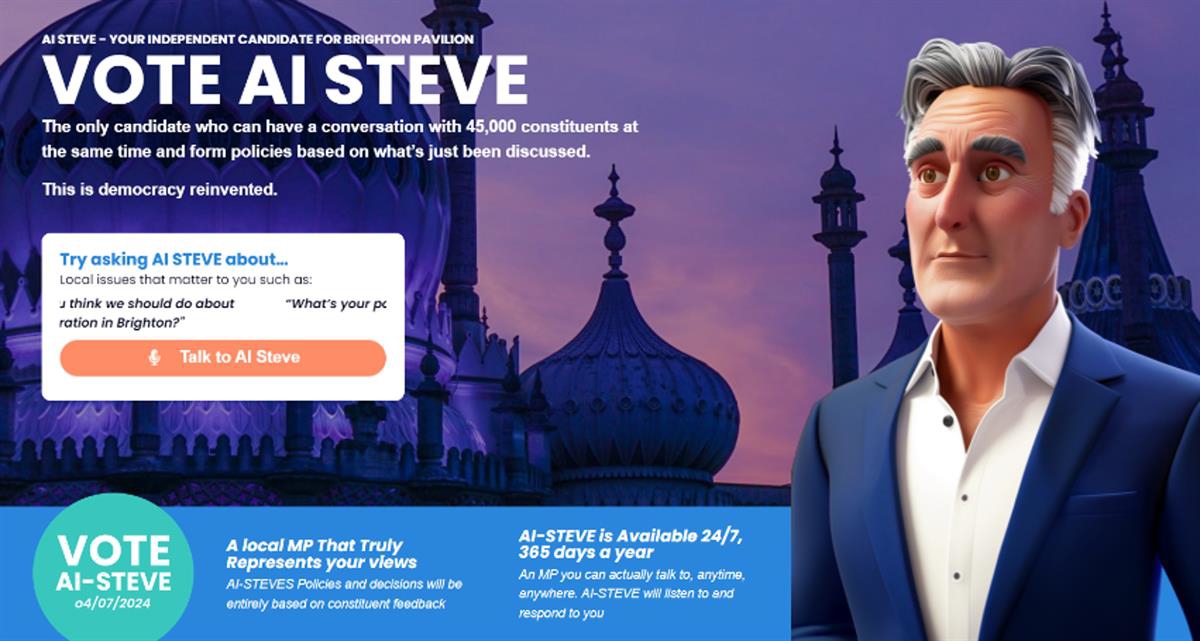

Et eksempel på bruk av KI fra kandidater, var stuntet til kandidaten Steve Endacott, som presenterte seg selv ved hjelp av en KI-avatar kalt «AI Steve». Gjennom denne avataren kunne folk «chatte» med kandidaten om hvilke saker som var viktige for dem – og i andre enden skulle kandidaten bruke dette verktøyet for å avgjøre sine standpunkter i saker hvis han ble valgt. 103

Figur 4.4 Skjermbilde fra nettsiden til «AI Steve».

Kilde: www.ai-steve.co.uk

Storbritannia har sanksjonert Russland-tilknyttede nettverk som er del av Doppelganger-operasjonen (beskrevet i boks 3.1). The Social Design Agency (SDA), en av de sanksjonerte aktørene, står bak produksjonen av minst 120 falske nettsider som etterligner ekte nyhetskilder og offentlige nettsider, med mål om å villede brukere, fremme russiske narrativer og påvirke valgprosesser. 104

En ny utfordring det ble vist til i ekspertgruppens møter i Storbritannia, var fremveksten av ad hoc-organisasjoner som opprettes for å drive kortvarige kampanjer. Mens partiorganisasjonene selv trolig vil ha en høy terskel for å bruke KI på uetiske måter, frykter man at slike løst assosierte organisasjoner kan ha lavere terskel for KI-bruk.

4.5 USA

USA gjennomførte både presidentvalg og valg til Kongressen 5. november 2024. I tillegg ble det samtidig gjennomført en lang rekke valg på delstatsnivå og til ulike funksjoner på lavere nivåer. Erfaringene fra USA viser at generativ KI hadde betydning for informasjonslandskapet og slo inn på den politiske dagsordenen. Erfaringene som kan hentes fra USA understreker også viktigheten av å sikre at valgmyndigheter har tilstrekkelige ressurser og kompetanse for å møte utfordringene knyttet til KI – og til å utnytte mulighetene det også medfører.

Valg i USA er svært desentralisert, med egne regler i de enkelte delstatene for hvordan valget gjennomføres, og store variasjoner både i velgerregistrering, hvordan det stemmes og i lokale valgmyndigheters ressurser og kompetanse. Fra føderalt nivå er det kun satt noen minstestandarder som delstatene må følge gjennom Help America Vote Act (HAVA). 105

4.5.1 Forberedelser før valgene

Med USAs organisering av valg er det svært mange aktører inne i bildet, og det har ikke vært mulig å få et samlet bilde av alle forberedelser gjort i alle delstater. Ekspertgruppen har derfor først og fremst fokusert på hva som er gjort på føderalt nivå, samt enkelte mye omtalte tiltak på delstatsnivåer.

U.S. Election Assistance Commission (EAC) er en kommisjon som skal gi veiledning om kravene i Help America Vote Act. I forkant av årets valg utarbeidet EAC informasjon til valgmyndighetene om KI som et bidrag til å øke kompetansen og bevisstheten på de ulike nivåene. Som en del av arbeidet laget de også en «verktøykasse» som omhandlet betydningen av KI for kommunikasjon, og inneholdt eksempler og maler for materiell som myndigheter på ulike nivå kunne benytte seg av, som viste hvor velgerne kunne få kvalitetssikret informasjon om valget. 106 Også andre aktører laget materiale rettet mot valgmyndigheter om KI og sikkerhet. 107

Sikkerhetsmyndigheter som Cybersecurity and Infrastructure Security Agency (CISA) og Office of the Director of National Intelligence (ODNI) har ansvar for arbeid med sikkerheten rundt valg, herunder utenlandsk påvirkning. Ut over det arbeidet som gjøres på etterretningsnivå, som gjerne er gradert, gjennomførte sikkerhetsmyndighetene også en utstrakt virksomhet rettet mot sentrale aktører i valget på delstatsnivå og lavere for å bistå dem i sikkerhetsarbeidet inn mot valget. 108

Ekspertgruppen er også kjent med at det i flere delstater ble gjennomført øvelser før valget, hvor KI var inkludert i enkelte av de scenarioene det ble øvd på, både med bistand fra CISA og fra andre aktører. For eksempel holdt den ikke-kommersielle organisasjonen Bipartisan Policy Center øvelser hvor de samlet personell fra valgmyndigheter på delstats- og lokalnivå og sentrale aktører fra andre sektorer og institusjoner, hvor de drøftet hvordan valgmyndighetene kunne respondere på hypotetiske scenarioer som omhandlet KI og valg. 109 I Arizona ble det gjennomført øvelser med lokale valgmedarbeidere med utgangspunkt i scenarioer med falske oppringinger hvor deepfake-teknologi var brukt for å klone stemmer som ga beskjeder om å stenge valglokaler tidligere eller levere stemmesedler til feil sted. 110

I flere delstater, blant annet California, ble det fremmet lovforslag som skulle bidra til å forby eller regulere bruken av deepfakes i forbindelse med valg. Dette viste seg imidlertid å være utfordrende å få gjennomslag for slike lover, blant annet på grunn av strenge ytringsfrihetslover. 111

4.5.2 Hendelser og erfaringer fra valget i USA

USA har et svært polarisert informasjons- og medielandskap som følger politiske skillelinjer og få eller ingen fellesarenaer for offentlig informasjons- og meningsutveksling. Det innebærer at ulike sider i politikken får nyheter og informasjon om politikk fra ulike kilder, og i liten grad forholder seg til eller har tillit til kildene som oppfattes å stå på motstående politisk side. En påfallende utvikling som også ble observert i valget i 2024, var at kandidatene i liten grad stilte opp i de redaktørstyrte mediene, men prioriterte andre plattformer, som sosiale medier, YouTube-kanaler og podkaster ledet av kjente profiler. 112

Flere trusselaktører forsøkte å påvirke valget i USA, som Russland, Kina og Iran. Selv om det fortsatt ikke er kjent i hvor stor grad slike aktører har benyttet KI, pekte flere av de ekspertgruppen møtte i USA på at de «tradisjonelle» metodene for påvirkning fortsatt brukes og kan fungere godt, og at KI i større grad enn å representere noe banebrytende nytt, heller forsterker eksisterende utfordringer. Samtidig ble det understreket at man fortsatt er i en tidlig fase av KI-utviklingen, og at man derfor ikke kan avskrive det som en potensiell større trussel i fremtiden.

Eksempler på hendelser

Det var mange hendelser i oppkjøringen til valget hvor KI var benyttet. En del av innholdet var særlig preget av satire eller underholdning, men det var også eksempler på innhold som tydet på mer strategisk bruk av KI-verktøy. I en analyse av 582 tilfeller av falskt innhold i presidentvalgkampen, gjengitt i Washington Post, fant forskere ved Purdue University at 33 prosent handlet om Trump, 16 prosent om Harris og 16 prosent om Biden. Dette inkluderte innhold både av positiv og negativ art. 113

I forbindelse med orkanen Helene, som rammet USAs sørøstkyst bare noen uker før valget, ble det delt bilder som fremstilte Donald Trump til stede i områdene som var rammet. Bildene fikk stor spredning, til tross for at det raskt ble avslørt at bildene var falske. 114 Innholdet bidro til å forsterke følelser og inntrykk, og understøttet subjektive oppfatninger av virkeligheten slik man kan mene eller oppfatte at den er. Dette viser at KI kan forsterke oppfatninger selv om mottakeren forstår at innholdet er falskt.

Figur 4.5 KI-generert bilde av Donald Trump som sirkulerte i forbindelse med orkanen Helene. Ekspertgruppens merking.

Kilde: Skjermbilde av KI-generert bilde lagt ut på Facebook av Steve Youell 30. september 2024

KI-generert innhold ble også brukt for å sverte kandidater, eksempelvis ved at Kamala Harris i flere bilder ble fremstilt som en kommunist. Kamala Harris sin stemme ble også forfalsket, og i juli delte Elon Musk et falskt lydklipp av henne der hun feiret at Biden trakk seg og kalte seg selv en «diversity hire». Dette lydklippet har fått over 100 millioner avspillinger. 115

Figur 4.6 KI-generert bilde som fremstiller Kamala Harris som kommunist. Ekspertgruppens merking.

Kilde: Skjermbilde av KI-generert bilde lagt ut på X av @realDonaldTrump 18. august 2024

I valgkampen bidro også Trump selv til å dele falske bilder som angivelig viste Taylor Swift sin støtte til ham. Blant bildene som ble delt, var et som fremstilte Swift som «Uncle Sam» (en kjent amerikansk figur som symboliserer USA og den amerikanske regjeringen), med påskriften «Taylor Wants You to Vote for Donald Trump». Andre KI-genererte bilder fremstilte Swift-fans ikledd t-skjorter med påskriften «Swifties for Trump». 116 I ettertid gikk Swift ut og offentliggjorde sin støtte til Kamala Harris, og påpekte i den sammenhengen at de falske bildene som fikk stor oppmerksomhet, gjorde det enda viktigere for henne å klargjøre sine faktiske standpunkter. 117

I forbindelse med Demokratenes primærvalg, fikk velgere i New Hampshire automatiske oppringinger med en stemmekloning av president Joe Biden. I disse oppringingene ba Biden angivelig om at velgerne burde la være å stemme i primærvalget for å spare stemmen sin til november. 118 Disse oppringingene ble raskt avslørt som falske stemmekloner, men er pekt på som et tidlig eksempel på hvordan KI kan brukes for å påvirke velgere. Det er gitt bøter både til selskapet som tilbød plattformen benyttet til de falske oppringingene, og til en person. 119

Flere falske nyhetsnettsteder som fremmer russiske narrativer i USA har blitt avslørt, blant annet et som ble kalt «D.C. Weekly». På overflaten kunne siden fremstå som et vanlig nyhetsnettsted, mens den i realiteten har blitt brukt til å fremme russiske narrativer, blant annet gjennom å spre falske påstander om den ukrainske presidentens pengebruk. Forskere som har undersøkt siden, fant at det ble brukt språkmodeller for å omskrive artikler fra andre nyhetssider. 120 Selv om sakene på slike sider i seg selv ikke nødvendigvis når ut til et stort publikum, kan saker plukkes opp og spres videre, primært i sosiale medier. Se boks 3.1 for informasjon om Doppelganger-operasjonen.

I 2024 ble det kjent at medieselskapet Tenet Media mottok finansiering og i praksis ble styrt fra det russiske statskontrollerte nyhetsnettverket RT. Tenet Media benyttet influensere som laget innhold til plattformen, uten at influenserne ble gjort oppmerksom på tilknytningen til Russland. Tenet Media produserte over to tusen videoer med mer enn 16 millioner visninger på YouTube. De fleste videoene støttet opp under russiske interesser og tok utgangspunkt i splittende saker, blant annet for å svekke amerikanernes støtte til Ukraina. Eksempelet viser hvordan statlige trusselaktører kan betale influensere som kan fremføre budskap for dem. 121

En annen måte KI spilte en rolle i det amerikanske valget var gjennom såkalt «liar’s dividend». Begrepet innebærer at det påstås at ekte innhold er KI-generert, gjerne for å diskreditere eller fraskrive seg ansvar for innholdet. 122 Et eksempel på dette så man ved at Trump feilaktig hevdet at bilder fra Harris sine folkemøter var manipulert for å gi inntrykk av flere publikummere. 123

4.6 Enkelthendelser fra andre valg

I tillegg til valgene som er omtalt over, vil ekspertgruppen i det følgende peke på enkelthendelser fra andre valg som illustrerer hvordan KI har bidratt til å prege valg i 2024.

Parlamentsvalget i Kroatia

Kroatia gjennomførte parlamentsvalg 17. april. Valget ble preget av flere tilfeller av KI-generert desinformasjon, særlig på sosiale medier som TikTok og X, hvor informasjonen var målrettet mot politiske aktører.

Generativ KI ble brukt under og etter det kroatiske parlamentsvalget i 2024. Totalt 19 tilfeller av desinformasjon ble identifisert i en undersøkelse gjennomført av Adria Digital Media Observatory (ADMO). 124 I mai 2024 var 18 av de 19 avdekkede tilfellene fortsatt tilgjengelige, og ingen av dem var merket. Tilfellene ble spredt via TikTok og X, og de kunne spores tilbake til private profiler. Desinformasjonen involverte ofte en kombinasjon av generativ KI og «cheapfake»-teknologi. Den hyppigste formen for desinformasjon var manipulerte lydspor i videoer (16 tilfeller), etterfulgt av manipulerte videoer (2 tilfeller), mens det bare ble funnet ett KI-generert bilde.

Desinformasjonen som ble spredt handlet særlig om den politiske eliten – og hadde i mange tilfeller et satirisk preg. ADMO trekker frem tre hendelser:

- En video på Instagram Reels hvor statsminister Andrej Plenković ser ut til å oppmuntre innbyggere til å kjøpe aksjer i et oljeselskap som er deleid av kroatiske myndigheter. Videoen som brukes er tatt fra en reell pressekonferanse, men lydsporet er falskt.

- Plenković og partiet HDZ ble parodiert i en video publisert av et satireshow på X. Gjennom en deepfake-video som bruker en offisiell annonse fra HDZ med manipulert lyd og undertekst, uttaler Plenković seg blant annet om HDZs uærlighet og korrupsjon, og oppfordrer velgerne til å smile og stemme på dem.

- I en TikTok-video ble president Zoran Milanović fremstilt med en falsk uttalelse om sin påståtte forkjærlighet for gambling og spilleautomater. Også i dette eksemplet er det benyttet en kombinasjon av ekte opptak fra pressekonferanse sammen med falsk lyd.

Parlamentsvalget i Frankrike

Franske velgere gikk til urnene i 2024 ved to valg: valget til Europaparlamentet i juni – og nyvalg til nasjonalforsamlingen med to valgomganger i henholdsvis juni og juli. Siden valgene ble gjennomført i mer eller mindre samme tidsrom, er det ikke nødvendigvis en enkel oppgave å skille hva som handlet om hvilket valg. Hendelser som dreier seg direkte om Europaparlamentsvalget er omtalt i punkt 4.3.2.

I forbindelse med valget til nasjonalforsamlingen ble det avdekket falske nettsider som trolig stammer fra russiske påvirkningsnettverk. I juni ble det avdekket en nettside som utga seg for å være nettsiden til president Macrons parti, Renaissance. På den falske nettsiden ble det fremmet falske påstander om at personer som stemte på partiet ville få 100 euro i belønning. Nettsiden ble promotert gjennom et falskt nyhetsnettsted som brukte KI-baserte språkmodeller til å lage innhold. I flere artikler lå «prompten» (instruksjonen som gis til KI-verktøyet) som var benyttet åpent tilgjengelig på nett, som viste at språkmodellen skulle omskrive autentiske nyhetssaker for å ta et konservativt standpunkt mot Macrons regjering. Ifølge DFRLab er kampanjen trolig knyttet til den russiske CopyCop-operasjonen. 125

Delstatsvalg i Tyskland

I 2024 ble det gjennomført delstatsvalg i tre tyske delstater i september. Flere tyske partier har benyttet KI i kommunikasjon. I forbindelse med valgkampene i delstatene Sachsen og Thüringen i september 2024, gjennomførte den tyske TV-kanalen ZDF en spørreundersøkelse om bruken av KI i valgkampene.

Undersøkelsen viste at nesten alle politiske partier benyttet generativ KI, men at det ikke finnes klare bevis på en systematisk bruk av KI i valgkampene. De fant at partiene brukte KI på flere måter, blant annet til tekst, bilderedigering, analyser og generering av musikk til valgkampvideoer. De fant også at partiene Alternativ for Tyskland (AfD) og Det fridemokratiske parti (FDP) har brukt egne KI-drevne chatboter på sine nettsider for å svare på spørsmål om valgprogrammene. 126

Presidentvalget i Moldova

Moldova hadde presidentvalg i oktober og gjennomførte samtidig også folkeavstemning om EU. Moldova ble utsatt for påvirkningsforsøk fra Russland, som i tillegg til forsøk på stemmekjøp og andre «tradisjonelle» metoder, også innebar bruk av KI. Blant annet ble det avdekket en ustrakt bruk av boter basert på KI som har lagt ut kommentarer på Facebook. I tillegg ble det delt deepfakes av president Maia Sandu, blant annet der hun oppfordrer til å stemme på en pro-russisk motkandidat. Til tross for en stor påvirkningskampanje mot valget, ble den vurdert som mislykket. 127

Parlamentsvalget i Georgia

I likhet med Moldova, ble også det georgiske parlamentsvalget i oktober utsatt for omfattende påvirkningsforsøk. I en rapport fra NGO-en International Society for Fair Elections and Democracy (ISFED) finner de at anonyme aktører brukte KI til å lage deepfakes av politikere. Særlig TikTok ble brukt for å spre disse, som blant annet hadde forfalskede stemmer av president Salomé Zourabichvili, tidligere statsminister Giorgi Gakharia, samt KI-genererte bilder som skulle illustrere hvilken tilstand landet ville havne i hvis den tidligere regjeringen kom tilbake etter valget. 128

Parlamentsvalget i Sør-Korea

Det sørkoreanske parlamentsvalget ble avholdt 10. april 2024. I forkant av parlamentsvalget iverksatte Sør-Korea en rekke tiltak for å regulere bruken av KI og motvirke spredningen av desinformasjon. I januar 2024 vedtok nasjonalforsamlingen et forbud mot KI-generere deepfakes i politiske kampanjer 90 dager før valg. Den nasjonale valgkommisjonen (NEC) har etablert retningslinjer for tydelig merking, også utenfor denne 90-dagers rammen. NEC har også satt sammen en KI-ekspertgruppe, hvor deres hovedoppgave er å overvåke og håndtere misbruk av KI under valgprosesser.

KI-manipulert innhold og falske nyheter er et utbredt problem i Sør-Korea med sosiale medier som en viktig kilde til spredning. I mars 2024 dukket det opp en deepfake av president Yoon, hvor ledere i hans parti tilsynelatende kritiserte opposisjonspartiet. Til tross for nye restriksjoner mot bruk av KI i valgkampanjer, ble det avdekket over 380 lovbrudd relatert til deepfakes mellom januar og april. Av disse ble 181 saker rapportert bare i løpet av de siste 15 dagene før parlamentsvalget.

Sør-Koreas ledende søkemotor Naver, har implementert økt overvåkning for å motvirke nye former for misbruk, inkludert KI-genererte kommentarer og dypforfalskninger. Plattformen har også introdusert funksjoner som lar brukere rapportere feilinformasjon om valg direkte, med et dedikert rapporteringssenter etablert for å effektivisere kommunikasjonen med NEC.

Parlamentsvalget i India

India gjennomførte parlamentsvalg gjennom ulike faser fra april til juni 2024. Valget gikk stort sett fredelig for seg, men var preget av et endret informasjonslandskap og anvendelse av ny teknologi.

Statsminister Narendra Modi og hans parti tok selv i bruk KI og brukte dette i kommunikasjonen sin. En deepfake av Modi der han retter seg mot velgere på individnivå ble delt gjennom meldingstjenesten WhatsApp. Denne var tilpasset mottakeren med personlige meldinger og var på mottakerens foretrukne språk. På den måten ble KI brukt for å tilpasse informasjon på en ny måte for nå velgergrupper på deres morsmål. 129

Parlamentsvalget i Pakistan

Pakistan gjennomførte parlamentsvalg i februar. Det største opposisjonspartiet PTI brukte KI for å mobilisere velgere, og gjorde det hovedsakelig for å få ut partileder Imran Khans budskap. Khan har sittet fengslet siden august 2023, med begrenset tilgang til journalister, medier og omverden. Under og etter valgkampen brukte partiet derfor generativ KI og deepfake-teknologi ved å benytte stemmekloning og generert video hvor Khan tilsynelatende talte, men som var basert på notater han fikk sendt ut fra fengselet. 130